- Polynominterpolation

-

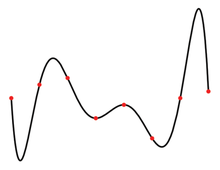

In der numerischen Mathematik versteht man unter Polynominterpolation die Suche nach einem Polynom, welches exakt durch vorgegebene Punkte (z. B. aus einer Messreihe) verläuft. Dieses Polynom wird Interpolationspolynom genannt und man sagt, es interpoliere die gegebenen Punkte.

Inhaltsverzeichnis

- 1 Anwendungen

- 2 Problemstellung

- 3 Lösungsverfahren

- 4 Interpolationsgüte

- 5 Verallgemeinerung

- 6 Literatur

- 7 Weblinks

- 8 Einzelnachweise

Anwendungen

Polynome lassen sich sehr leicht integrieren und ableiten. Deswegen tauchen interpolierende Polynome an vielen Stellen in der numerischen Mathematik auf, beispielsweise bei der numerischen Integration und entsprechend bei Verfahren zur numerischen Lösung gewöhnlicher Differentialgleichungen.

Problemstellung

Für n + 1 gegebene Wertepaare

mit paarweise verschiedenen Stützstellen xi wird das eindeutig bestimmte Polynom P gesucht, das alle Gleichungen P(xi) = fi erfüllt.

mit paarweise verschiedenen Stützstellen xi wird das eindeutig bestimmte Polynom P gesucht, das alle Gleichungen P(xi) = fi erfüllt.Hierbei ist P im Vektorraum der Polynome mit Grad n oder kleiner zu suchen, kurz

. Das Problem lässt sich lösen, indem das durch die Gleichungen P(xi) = fi definierte Lineare Gleichungssystem gelöst wird. Die Lösung des Gleichungssystems sind genau die Koeffizienten des gesuchten Polynoms P. Da sich ein und dasselbe Polynom aber unterschiedlich darstellen lässt, je nachdem welche Basis für den Vektorraum Πn gewählt wird, kann man ganz verschiedene Gleichungssysteme erhalten. Wählt man für Πn die Standardbasis

. Das Problem lässt sich lösen, indem das durch die Gleichungen P(xi) = fi definierte Lineare Gleichungssystem gelöst wird. Die Lösung des Gleichungssystems sind genau die Koeffizienten des gesuchten Polynoms P. Da sich ein und dasselbe Polynom aber unterschiedlich darstellen lässt, je nachdem welche Basis für den Vektorraum Πn gewählt wird, kann man ganz verschiedene Gleichungssysteme erhalten. Wählt man für Πn die Standardbasis  , also für P die Darstellung

, also für P die Darstellung  , so erhält man ein Gleichungssystem mit der Vandermonde-Matrix:

, so erhält man ein Gleichungssystem mit der Vandermonde-Matrix: .

.

Diese ist regulär, wenn die Stützstellen xi paarweise verschieden sind, das Gleichungssystem lässt sich dann eindeutig lösen. Somit ist die Existenz und Eindeutigkeit des gesuchten Polynoms P immer sichergestellt. Weiterhin ist gezeigt, dass das Polynom P höchstens vom Grad n ist. Trotz der theoretischen Machbarkeit wird diese Art der Interpolation in der Praxis nicht durchgeführt da die Berechnung der Vandermonde-Matrix aufwendig ist (

) und zudem schlecht konditioniert bei einer ungeeigneten Wahl der Stützstellen.

) und zudem schlecht konditioniert bei einer ungeeigneten Wahl der Stützstellen.Lösungsverfahren

Obiges Gleichungssystem ließe sich beispielsweise mit dem Gaußschen Eliminationsverfahren lösen. Der Aufwand dafür ist mit

allerdings vergleichsweise groß. Bei Wahl einer anderen Basis als der Standardbasis zur Beschreibung des Polynoms P kann der Aufwand verringert werden.

allerdings vergleichsweise groß. Bei Wahl einer anderen Basis als der Standardbasis zur Beschreibung des Polynoms P kann der Aufwand verringert werden.Lagrangesche Interpolationsformel

Eher für theoretische Betrachtungen günstig ist eine Darstellung in der Lagrange-Basis. Die Basisfunktionen sind die Lagrange-Polynome

die so definiert sind, dass

gilt, wobei δik das Kronecker-Delta darstellt. Die Lösung des Interpolationsproblems lässt sich dann einfach angeben als

mit den Stützwerten fi. Dies wird häufig benutzt, um die Existenz der Lösung des Interpolationsproblems zu beweisen. Damit entspricht die Matrix

genau der Einheitsmatrix. Ein Vorteil der Lagrange-Basis ist somit, dass die Basisfunktionen

genau der Einheitsmatrix. Ein Vorteil der Lagrange-Basis ist somit, dass die Basisfunktionen  von den Stützwerten fi unabhängig sind. Dadurch lassen sich verschiedene Sätze von Stützwerten fi mit gleichen Stützstellen xi schnell interpolieren, wenn die Basisfunktionen

von den Stützwerten fi unabhängig sind. Dadurch lassen sich verschiedene Sätze von Stützwerten fi mit gleichen Stützstellen xi schnell interpolieren, wenn die Basisfunktionen  einmal bestimmt worden sind. Ein Nachteil dieser Darstellung ist jedoch, dass alle Basisvektoren bei Hinzunahme einer einzelnen Stützstelle komplett neu berechnet werden müssen, weshalb dieses Verfahren für die meisten praktischen Zwecke zu aufwändig ist.

einmal bestimmt worden sind. Ein Nachteil dieser Darstellung ist jedoch, dass alle Basisvektoren bei Hinzunahme einer einzelnen Stützstelle komplett neu berechnet werden müssen, weshalb dieses Verfahren für die meisten praktischen Zwecke zu aufwändig ist.Newtonscher Algorithmus

In diesem Verfahren wird das Polynom P in Newton-Basis dargestellt, so dass die Koeffizienten effizient mit dem Schema der dividierten Differenzen bestimmt werden können. Eine effiziente Auswertung des Polynoms kann dann mithilfe des Horner-Schemas erfolgen.

Ansatz: Newton-Basis

Als Ansatz für das gesuchte Interpolationspolynom P wählt man die Newton-Basisfunktionen N0(x) = 1 und

mit

mit

so dass P dargestellt wird mit der Newtonschen Interpolationsformel

Das Gleichungssystem der Gleichungen P(xi) = fi hat dann die Form

Im Gegensatz zur komplizierten Vandermonde-Matrix bei Wahl der Standardbasis

erhält man bei Wahl der Newton-Basis also eine einfach strukturierte untere Dreiecksmatrix und das Gleichungssystem lässt sich einfach lösen.

erhält man bei Wahl der Newton-Basis also eine einfach strukturierte untere Dreiecksmatrix und das Gleichungssystem lässt sich einfach lösen.Bestimmung der Koeffizienten: Schema der dividierten Differenzen

Die Koeffizienten ci werden aber nicht direkt aus dem obigen Gleichungssystem bestimmt, sondern effizienter mithilfe der dividierten Differenzen. Durch Induktion beweist man mit der Rekursionsformel von Aitken, dass für die Koeffizienten ci gilt

![c_i = [x_0, \cdots, x_i]f](f/6cf87e76c03002ef33cf945f25ba9c8d.png) .

.

Dabei sind für i < j die dividierten Differenzen

![[x_i, \dots, x_j]f](7/e675a7cce410d9dcc2a3589815419474.png) rekursiv definiert durch

rekursiv definiert durch![[x_i]f = f_i \qquad](a/a4a99bb7a5a62c79e00b45bd7ee410d3.png)

![[x_i,\dots,x_j]f = \frac {[x_{i+1},\dots,x_j]f-[x_i,\dots,x_{j-1}]f}{x_j - x_i}](e/5aeb5327ba8da205323095829e13c6ce.png) .

.

Die Notation mit angehängtem f erklärt sich dadurch, dass oft eine unbekannte Funktion f angenommen wird, die bei bekannten Funktionswerten fi = f(xi) interpoliert werden soll.

Die rekursive Berechnung der dividierten Differenzen lässt sich wie folgt veranschaulichen. Dabei sind die gesuchten Koeffizienten ci genau die oberste Schrägzeile:

Offensichtlich ist bei Ergänzung der n + 1 Wertepaare (xi,fi) um einen weiteren Punkt (xn + 1,fn + 1) in obigem Schema nur eine weitere Zeile hinzuzufügen, um den zusätzlichen Koeffizienten

![c_{n+1} = [x_0, \dots, x_{n+1}]f](3/b63026509b1a22da8aae03d8886b8bbf.png) zu berechnen. Die zuvor bestimmten Koeffizienten

zu berechnen. Die zuvor bestimmten Koeffizienten  müssen nicht neu berechnet werden.

müssen nicht neu berechnet werden.Auswertung des Polynoms: Horner-Schema

Wenn die Koeffizienten ci des Interpolationspolynoms P einmal bekannt sind, kann man es effizient mithilfe des Horner-Schemas auswerten. Dazu schreibt man P in der Form (einfache Umformung der Newtonschen Interpolationsformel)

,

,

so dass P(x) rekursiv berechnet werden kann durch

Dies erfordert einen Aufwand von O(n).

Algorithmus von Neville-Aitken

Ähnlich wie im Newtonschen Algorithmus wird beim Algorithmus von Neville-Aitken die Lösung rekursiv berechnet. Dazu bezeichne

das eindeutig bestimmte Interpolationspolynom k-ten Grades zu den k + 1 Stützpunkten

das eindeutig bestimmte Interpolationspolynom k-ten Grades zu den k + 1 Stützpunkten  . Es gilt dann die Rekursionsformel von Aitken:

. Es gilt dann die Rekursionsformel von Aitken:Beweisen lässt sie sich durch Einsetzen von xi, wodurch man verifiziert, dass die rechte Seite der Gleichung die Interpolationsbedingung erfüllt. Die Eindeutigkeit des Interpolationspolynoms liefert dann die Behauptung.

Mit dem Schema von Neville kann die Auswertung von

dann rekursiv erfolgen:

dann rekursiv erfolgen:

Vergleich der Lösungsverfahren

Möchte man alle Koeffizienten des Interpolationspolynoms P bestimmen, so bietet der Newtonsche Algorithmus hierfür den geringsten notwendigen Aufwand von

. Das so bestimmte Polynom lässt sich dann mit

. Das so bestimmte Polynom lässt sich dann mit  Operationen an einer Stelle auswerten. Darum ist der Newtonsche Algorithmus gut geeignet, wenn das Interpolationspolynom an vielen Stellen ausgewertet werden soll. Auch lassen sich effizient weitere Stützpunkte hinzufügen. Liegen die Stützstellen oder die Stützwerte allerdings zu nahe beieinander, so besteht die Gefahr der Auslöschung bei der Bestimmung der dividierten Differenzen.

Operationen an einer Stelle auswerten. Darum ist der Newtonsche Algorithmus gut geeignet, wenn das Interpolationspolynom an vielen Stellen ausgewertet werden soll. Auch lassen sich effizient weitere Stützpunkte hinzufügen. Liegen die Stützstellen oder die Stützwerte allerdings zu nahe beieinander, so besteht die Gefahr der Auslöschung bei der Bestimmung der dividierten Differenzen.Der Neville-Aitken-Algorithmus ist dagegen gut geeignet, wenn ein Interpolationspolynom nur an ganz wenigen Stellen ausgewertet werden soll, dabei ist er weniger anfällig gegen Auslöschung. Auch im Neville-Aitken-Algorithmus lassen sich effizient neue Stützpunkte hinzufügen. So kann z. B. eine gewünschte Genauigkeit der Interpolation an einer Stelle durch Hinzufügen immer weiterer Stützstellen erreicht werden.

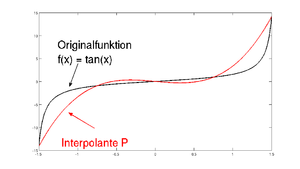

Beispiel: Interpolation der Tangensfunktion

Interpoliere die Funktion f(x) = tan(x) bei gegebenen Punkten

x0 = − 1,5 f(x0) = − 14,101420 x1 = − 0,75 f(x1) = − 0,931596 x2 = 0 f(x2) = 0 x3 = 0,75 f(x3) = 0,931596 x4 = 1,5 f(x4) = 14,101420 Lösung mit Lagrange

Die Lagrange-Basisfunktionen sind

also ist das Interpolationspolynom

Lösung mit Newton

Die dividierten Differenzen sind hier

und das Interpolationspolynom ist

Verwendet man genauere Startwerte f(xi), verschwinden der erste und der dritte Koeffizient.

Interpolationsgüte

Fehlerabschätzung

Gegeben sei eine Funktion f, deren n+1 Funktionswerte fi an den Stellen xi durch das Polynom P interpoliert werden. Mit I sei das kleinste Intervall bezeichnet, das die Stützstellen xi und eine Stelle x enthält. Ferner sei f (n+1)-mal stetig differenzierbar auf I. Dann existiert ein

für das gilt:

für das gilt:Insbesondere ist also bezüglich der Supremumsnorm auf [a,b]:

Fehleroptimierung nach Tschebyschow[1]

Der Fehler hängt also von einer Ableitung von f ab und von dem Produkt

, also den Stützstellen xi. Manchmal ist man in der Position, dass man sich Stützstellen selbst wählen kann; Etwa, wenn man ein physikalisches Experiment durchführt oder aber auch bei einigen Verfahren zur numerischen Lösung von Differentialgleichungen. In diesem Fall ist die Frage interessant, für welche Stützstellen das Produkt wn(x) in der Maximumsnorm minimal wird.

, also den Stützstellen xi. Manchmal ist man in der Position, dass man sich Stützstellen selbst wählen kann; Etwa, wenn man ein physikalisches Experiment durchführt oder aber auch bei einigen Verfahren zur numerischen Lösung von Differentialgleichungen. In diesem Fall ist die Frage interessant, für welche Stützstellen das Produkt wn(x) in der Maximumsnorm minimal wird.Tschebyschow hat diese Frage vollständig geklärt: Betrachte die Polynome Tn + 1(x) = cos((n + 1)arccos(x)) mit den Nullstellen

. (Die „Tschebyschow-Polynome“ und „Tschebyschow-Punkte“) Die ersten Tschebyschow-Polynome sind:

. (Die „Tschebyschow-Polynome“ und „Tschebyschow-Punkte“) Die ersten Tschebyschow-Polynome sind:Man kann dann beweisen dass jedes Polynom der Form wn auf dem Intervall [ − 1,1] durch ein normiertes Tschebyschow-Polynom beschränkt bleibt. Diese Aussage kann dann mit der Transformation

auf den Fall eines allgemeinen Intervalls

![[a,b]\subset\mathbb{R}](2/1c23485a70fd71d88fb40e3505fcd155.png) übertragen werden. Der Beweis liefert auch die Abschätzung

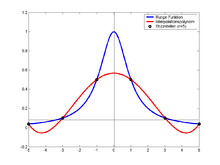

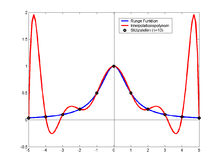

übertragen werden. Der Beweis liefert auch die AbschätzungRunges Phänomen

Verbessert sich die Interpolationsgüte, wenn mehr Stützpunkte hinzugefügt werden? Im Allgemeinen nicht: Bei hohem Grad des Polynoms kann es vorkommen, dass die Polynomfunktion kaum noch der zu interpolierenden Funktion ähnelt, was auch als Runges Phänomen bekannt ist. Polynome streben im Grenzfall

gegen

gegen  . Verhält sich die zu interpolierende Funktion anders, etwa periodisch oder asymptotisch konstant, treten starke Oszillationen in der Nähe der Intervallgrenzen auf. Für solche Funktionen sind Polynominterpolationen über das gesamte Intervall relativ ungeeignet.

. Verhält sich die zu interpolierende Funktion anders, etwa periodisch oder asymptotisch konstant, treten starke Oszillationen in der Nähe der Intervallgrenzen auf. Für solche Funktionen sind Polynominterpolationen über das gesamte Intervall relativ ungeeignet.Tschebyschow-Stützstellen, die an den Intervallgrenzen dichter liegen, können zwar den Gesamtfehler der Interpolation verkleinern, dennoch empfiehlt sich ein Wechsel des Interpolationsverfahrens, etwa zur Spline-Interpolation. Runge gab für dieses Phänomen ein Beispiel an, die nach ihm benannte Runge-Funktion:

Konvergenzverhalten

Es gibt aber Bedingungen, unter denen sich die Interpolationsgüte mit steigender Anzahl Stützpunkte verbessert: Wenn das Stützstellengitter immer "feiner" wird und eine ganze Funktion interpoliert wird. Genauer: Sei f eine analytische Funktion auf dem Intervall

![I=[a,b] \subset \R](9/18916bbdcdd4526ca0c83316dad04d38.png) . Für eine Intervallteilung

. Für eine Intervallteilungsei ihre Norm definiert durch

.

.

Zu jeder Intervallteilung Δm gibt es ein eindeutig bestimmtes Polynom

, das f an den Stützstellen Δm interpoliert. Gilt für eine Folge von Intervallteilungen

, das f an den Stützstellen Δm interpoliert. Gilt für eine Folge von Intervallteilungen  , so folgt

, so folgt  gleichmäßig.

gleichmäßig.Allerdings lässt sich zu jeder Folge

auch eine auf I stetige Funktion f finden, so dass

auch eine auf I stetige Funktion f finden, so dass  nicht gleichmäßig gegen f konvergiert (Satz von Faber[2]).

nicht gleichmäßig gegen f konvergiert (Satz von Faber[2]).Verallgemeinerung

Bisher wurden die Stützstellen xi des Interpolationspolynoms P als paarweise verschieden angenommen. Bei der Hermiteinterpolation ist das nicht der Fall. Mehrfach vorkommende Stützstellen werden dabei als Ableitungen der zu interpolierenden Funktion f interpretiert.

Literatur

- Hans R. Schwarz, Norbert Köckler: Numerische Mathematik, 5. Aufl., Teubner, Stuttgart 2004, ISBN 3-519-42960-8

- Stoer, Bulirsch: Numerische Mathematik 1. 10. Auflage. Springer Verlag, Berlin, Heidelberg, New York 2007, ISBN 978-3-540-45389-5, 2.1 Interpolation durch Polynome, S. 39-57 (Behandelt die Verfahren nach Lagrange, Neville-Aitken und Newton, Hermite-Interpolation und Fehlerabschätzung jeweils mit Beispielen und Beweisen.).

- Press, Teukolsky, Vetterling, Flannery: Numerical Recipes. The Art of Scientific Computing. 3. Auflage. Cambridge University Press, Cambridge 2007, ISBN 978-0-521-88407-5, 3.2 Polynomial Interpolation and Extrapolation, S. 118-120 (Neville-Aitken-Algorithmus mit C++-Implementation).

Weblinks

Wikibooks: Dividierte Differenzen & Horner-Schema – Implementierungen in der Algorithmensammlung

Wikibooks: Dividierte Differenzen & Horner-Schema – Implementierungen in der Algorithmensammlung- Seite zu Newton, Lagrange und Cubic Spline mit Java-Applet

- Erläuterungen und Beispiel zur Lagrange-Interpolation

Einzelnachweise

- ↑ Jochen Werner: 10.4. In: Numerische Mathematik, 1, Vieweg Studium, Nr.32, Vieweg Verlagsgesellschaft 1992, ISBN 3528072326

- Auch hier (4.1.3.)

- ↑ Andrei Nikolajewitsch Kolmogorow, et al.: 4. In: Mathematics of the 19th Century, 1, Birkhäuser 1998, ISBN 3764358459

- Auch hier (Google Books)

Wikimedia Foundation.

![\begin{array}{crcrccrcrc}

[x_0]f \\

& \searrow \\{}

[x_1]f & \rightarrow & [x_0,x_1]f \\

& \searrow & & \searrow \\{}

[x_2]f & \rightarrow & [x_1,x_2]f & \rightarrow & [x_0,x_1,x_2]f \\{}

\vdots & \vdots & \vdots & \vdots & \vdots &\ddots \\{}

& \searrow & & \searrow & & & \searrow \\{}

[x_{n-1}]f & \rightarrow & [x_{n-2},x_{n-1}]f & \rightarrow & [x_{n-3},x_{n-2},x_{n-1}]f

& \cdots & \rightarrow & [x_0\ldots x_{n-1}]f \\

& \searrow & & \searrow & & & \searrow && \searrow\\{}

[x_n]f & \rightarrow & [x_{n-1},x_n]f & \rightarrow & [x_{n-2},x_{n-1},x_n]f

& \cdots & \rightarrow & [x_1\ldots x_n]f & \rightarrow & [x_0\ldots x_n]f

\end{array}](5/d559a3007e474dd52bcc79fa0106c7ed.png)

![\begin{align}

\xi\in[-1,1] &\rightsquigarrow x=\frac{a+b}{2}+\frac{b-a}{2}\xi &\in [a,b] \\

x\in[a,b] &\rightsquigarrow \xi = \frac{2x-a-b}{b-a} &\in [-1,1]

\end{align}](9/099619223b757f1d4afff2b19dd675fb.png)

![\begin{align}

\|w_n(x)\|_{[a,b],\infty} =\max_{x\in[a,b]} |w_n(x)| =2\left(\frac{b-a}{4}\right)^{n+1}

\end{align}](8/8d8efe6435eb9966bd035627a68dae48.png)

![f(x)=\frac{1}{1+x^2}\,,\quad x\in[-5;5]](8/b083d286ce15bb5fa2f844de322ba929.png)