- Mutual Information

-

Transinformation oder gegenseitige Information ist eine Größe aus der Informationstheorie, die die Stärke des statistischen Zusammenhangs zweier Zufallsgrößen angibt. Die Transinformation wird auch als Synentropie bezeichnet. Im Gegensatz zur Synentropie einer Markov-Quelle 1. Ordnung, welche die Redundanz einer Quelle zum Ausdruck bringt und somit minimal sein soll, stellt die Synentropie eines Kanals den mittleren Informationsgehalt dar, der vom Sender zum Empfänger gelangt und soll somit maximal sein.

Ein gedächtnisloser Kanal verbindet die zwei Quellen X und Y. Von X nach Y fließt Transinformation. Die Empfänger-Quelle Y der Entsende-Quelle X verhält sich wie eine Quelle. Es wird nicht zwischen Empfänger und Entsender unterschieden. Je mehr die Quellen von einander abhängen, desto mehr Transinformation ist vorhanden.

Ein gedächtnisloser Kanal verbindet die zwei Quellen X und Y. Von X nach Y fließt Transinformation. Die Empfänger-Quelle Y der Entsende-Quelle X verhält sich wie eine Quelle. Es wird nicht zwischen Empfänger und Entsender unterschieden. Je mehr die Quellen von einander abhängen, desto mehr Transinformation ist vorhanden.Gelegentlich wird auch die Bezeichnung relative Entropie verwendet, diese entspricht jedoch der Kullback-Leibler-Divergenz.

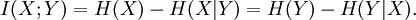

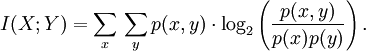

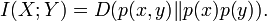

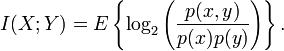

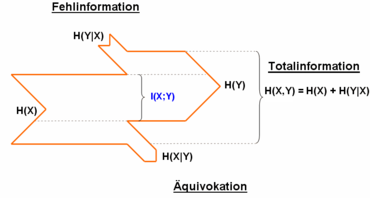

Die Transinformation steht in einem engen Zusammenhang zur Entropie und zur bedingten Entropie. So berechnet sich die Transinformation I(X;Y) folgendermaßen:

Definition über die Differenz von Quell-Entropie und Äquivokation bzw. Empfangs-Entropie und Fehlinformation:

Definition über Wahrscheinlichkeiten:

Definition über die Kullback-Leibler-Divergenz:

Definition über den Erwartungswert:

Verschwindet die Transinformation, so spricht man von statistischer Unabhängigkeit der beiden Zufallsgrößen. Die Transinformation wird maximal, wenn sich eine Zufallsgröße vollkommen aus der anderen berechnen lässt.

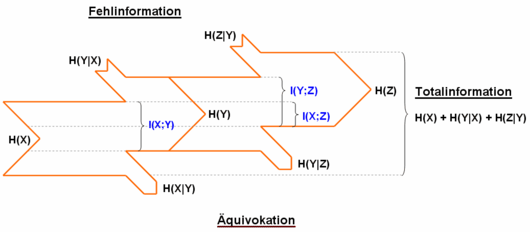

Zwei gedächtnislose Kanäle verbinden drei Quellen. Von der Senderquelle X kann der Empfängerquelle Y eine Transinformation von I(x;y) übermittelt werden. Wird diese Transinformation weiter geleitet so empfängt die Empfängerquelle Z eine Transinformation von I(X;Z). Man kann hier deutlich sehen, dass die Transinformation von der Menge an Äquivokation abhängt.

Zwei gedächtnislose Kanäle verbinden drei Quellen. Von der Senderquelle X kann der Empfängerquelle Y eine Transinformation von I(x;y) übermittelt werden. Wird diese Transinformation weiter geleitet so empfängt die Empfängerquelle Z eine Transinformation von I(X;Z). Man kann hier deutlich sehen, dass die Transinformation von der Menge an Äquivokation abhängt.Die Transinformation beruht auf der von Claude Shannon eingeführten Entropie (Unsicherheit, mittlerer Informationsgehalt). Nimmt die Transinformation zu, so verringert sich die Unsicherheit über eine Zufallsgröße unter der Voraussetzung, dass die andere bekannt ist. Ist die Transinformation maximal, verschwindet die Unsicherheit folglich. Wie aus der formalen Definition zu sehen ist, wird die Ungewissheit einer Zufallsvariable durch Kenntnis einer anderen reduziert. Dies drückt sich in der Transinformation aus.

Die Transinformation spielt beispielsweise bei der Datenübertragung eine Rolle. Mit ihr lässt sich die Kanalkapazität einer Leitung bestimmen.

Entsprechend kann auch eine Entropie H(Z) von zwei verschiedenen, wiederum voneinander abhängigen, Entropien abhängen:

In der Fachliteratur werden verschiedene Begriffe verwendet. Die Äquivokation wird auch als "Verlustentropie" und die Fehlinformation auch als "Irrelevanz" bezeichnet. Die Transinformation wird auch als "Transmission" oder "mittlerer Transinformationsgehalt" bezeichnet.

Weblinks

- Peter E. Latham, Yasser Roudi: „Mutual information“ in Scholarpedia (englisch, inkl. Literaturangaben)

Wikimedia Foundation.