- Akaike Information Criterion

-

Ein Informationskriterium ist ein Kriterium zur Auswahl eines Modells in der angewandten Statistik bzw. der Ökonometrie. Dabei gehen die Anpassungsgüte des geschätzten Modells an die vorliegenden empirischen Daten (Stichprobe) und Komplexität des Modells, gemessen an der Anzahl der Parameter, in die Beurteilung ein. Die Anzahl der Parameter wird dabei "strafend" berücksichtigt, da sonst umfassende Modelle mit vielen Parametern bevorzugt würden. In diesem Sinne ist das korrigierte Bestimmtheitsmaß, das auf Henri Theil (1970) zurückgeht, ein Vorläufer der heute bekannten Informationskriterien.

Allen heute verwendeten Informationskriterien ist gleich, dass sie in zwei verschiedenen Formulierungen vorliegen. Entweder ist das Maß für die Anpassungsgüte als die maximale Wahrscheinlichkeit oder als die minimale Varianz der Residuen formuliert. Hieraus ergeben sich unterschiedliche Interpretationsmöglichkeiten. Beim Ersteren ist das Modell "am besten", bei dem das jeweilige Informationskriterium den höchsten Wert hat (die "strafende" Anzahl der Parameter muss dabei abgezogen werden). Beim Letzteren ist das Modell mit dem niedrigsten Wert des Informationskriteriums am besten (die Anzahl der Parameter muss "strafend" addiert werden).

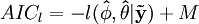

Das historisch älteste Kriterium wurde 1973 von Hirotugu Akaike als "an information criterion" (engl.) vorgeschlagen. Heutzutage ist es als Akaikes Informationskriterium (engl. Akaike's Information Criterion, AIC) bekannt und wird vorwiegend in der Ökonometrie verwendet. Es lässt sich mit der logarithmierten Likelihood-Funktion l wie folgt darstellen:

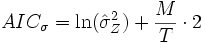

Unter Verwendung der minimalen Varianz der Residuen ergibt sich im klassischen Regressionsmodell mit normalverteilten Fehlern folgende Notation:

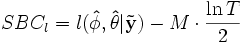

Der Nachteil des Informationskriteriums von Akaike ist, dass der Strafterm von der Stichprobengröße unabhängig ist. Bei großen Stichproben sind Verbesserungen der Log-Likelihood bzw. der Residualvarianz "leichter" möglich, weshalb das Kriterium bei großen Stichproben tendenziell Modelle mit verhältnismäßig vielen Parametern vorteilhaft erscheinen lässt. Deshalb empfiehlt sich die Verwendung des durch Gideon Schwarz 1978 vorgeschlagenen Bayesschen Informationskriteriums (engl. Bayesian Information Criterion[BIC] oder Schwarz-Bayes Criterion[SBC]):

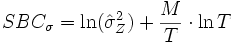

bzw.

Bei diesem Kriterium wächst der Faktor des Strafterms logarithmisch mit der Anzahl der Beobachtungen T. Bereits ab acht Beobachtungen (ln 8 = 2,07944 > 2) bestraft das SBC zusätzliche Parameter schärfer als das AIC.

Zur Notation:

T: Anzahl der beobachteten Stichprobenwerte

M: Anzahl der geschätzten Parameter

σ: Standardabweichung

Z: Störvariable

: empirisch gemessene Varianz der Störvariablen Z (als Proxy wird hier die Varianz der Residuen verwendet)

: empirisch gemessene Varianz der Störvariablen Z (als Proxy wird hier die Varianz der Residuen verwendet)Letzteres Modell wird vor allem in der Soziologie häufig verwendet. Kuha (2004) weist auf die unterschiedlichen Ziele der beiden Kenngrößen hin: Während das BIC das wahre Modell zeigen soll, wird beim AIC die Existenz eines wahren Modells ausgeschlossen und man versucht, möglichst gute Vorhersagen zu treffen.

Daneben existieren weitere, seltener verwendete Informationskriterien, wie:

- das von Hannan-Quinn

- das Deviance Information Criterion - DIC (Spiegelhalter, Best, Carlin und van der Linde (2002))

- EIC (Ishiguro, Sakamoto, and Kitgawa (1997))

- FIC (Wei (1992)), GIC (Nishii (1984))

- NIC (Murata, Yoshizawa und Amari (1991))

- TIC (Takeuchi (1976))

Siehe auch

- Strukturgleichungsmodellierung

- Jorma Rissanen

- Minimum Description Length (MDL)

- Risk inflation information criterion (RIC)

- Maximum-Entropie-Methode (MEM)

Literatur

- Hirotugu Akaike: Information theory and an extension of the maximum likelihood principle. In: B. N. Petrov (Hrsg.) u.A.: Proceedings of the Second International Symposium on Information Theory Budapest: Akademiai Kiado 1973. S. 267-281

- Kenneth P. Burnham und David R. Anderson: Model Selection and Multimodel Inference: A Practical Information-Theoretic Approach. Springer-Verlag, New York 2002, ISBN 0-387-95364-7

- Kenneth P. Burnham/David R. Anderson (2004): Multimodel Inference: Understanding AIC and BIC in Model Selection, in: Sociological Methods and Research, Vol. 33, 2004, Seite 261-304

- Jouni Kuha (2004): AIC and BIC: Comparisons of Assumptions and Performance, in: Sociological Methods and Research, Vol. 33, 2004, Seite 188-229

- Gideon Schwarz: Estimating the Dimension of a Model. In: Annals of Statistics. 2/6/1978. S. 461-464 (Originalartikel: http://www.math.tau.ac.il/~yekutiel/MA%20seminar/Schwarz%201978.pdf)

- David L. Weakliem (2004): Introduction to the Special Issue on Model Selection, in: Sociological Methods and Research, Vol. 33, 2004, Seite 167-187

Wikimedia Foundation.