- Konfidenzintervall einer unbekannten Wahrscheinlichkeit

-

Ein Konfidenzintervall einer unbekannten Wahrscheinlichkeit ist ein Konfidenzintervall (Vertrauensbereich) für den Parameter p der Binomialverteilung (nach Beobachtung von k Treffern in einer Stichprobe der Länge n).

Exakte Konfidenzintervalle, wie das Clopper-Pearson-Intervall, erhält man mit Hilfe der Binomialverteilung. Es gibt aber auch Näherungsmethoden, die (meistens) auf der Approximation der Binomialverteilung durch die Normalverteilung basieren.[1]

Inhaltsverzeichnis

Einführendes Beispiel

Um den unbekannten relativen Anteil p einer politischen Partei A in der Wählerschaft zu schätzen, werden in einer Meinungsumfrage n = 400 Personen befragt, ob sie die Partei A wählen werden. Die Anzahl X der Befragten, die angeben die Partei A zu wählen, ist vom Zufall abhängig und deshalb eine Zufallsvariable. Wenn die befragten Personen rein zufällig ausgewählt werden, ist die Zufallsvariable X binomialverteilt mit den Parametern n = 400 und dem unbekannten Parameter p. Nehmen wir an, in der Umfrage haben k = 20 Befragte angegeben, die Partei A zu wählen. Man berechnet eine Schätzung

von p als:

von p als: .

.

Man nennt dies eine Punktschätzung, weil nur ein Wert als Schätzung von p berechnet wird.

Der wahre Wert des relativen Anteils p kann sowohl kleiner, als auch größer als der Punktschätzer

sein. Mit Sicherheit gilt nur, dass p jeden Wert zwischen 0 und 1 annehmen kann (in unserem Beispiel kann p nicht gleich 0 oder 1 sein, da sonst keiner oder alle Befragten die Partei A wählen würden). Wünschenswert wäre ein Konfidenzintervall [pu, po] für p. Beim vielfachen Wiederholen des Verfahrens sollen die berechneten Konfidenzintervalle in den „meisten Fällen“ den Parameter p enthalten. Wie oft das der Fall sein soll, wird mittels der Vertrauenswahrscheinlichkeit (oder auch Konfidenzniveau) γ ausgedrückt. Das berechnete Intervall [pu, po] wird Konfidenzintervall (oder Vertrauensbereich) genannt. Oft wird γ gleich 95 % gewählt. Das bedeutet, dass bei Wiederholung des Verfahrens für 95 % aller Stichproben die Aussage p ∈ [pu, po] richtig ist.

sein. Mit Sicherheit gilt nur, dass p jeden Wert zwischen 0 und 1 annehmen kann (in unserem Beispiel kann p nicht gleich 0 oder 1 sein, da sonst keiner oder alle Befragten die Partei A wählen würden). Wünschenswert wäre ein Konfidenzintervall [pu, po] für p. Beim vielfachen Wiederholen des Verfahrens sollen die berechneten Konfidenzintervalle in den „meisten Fällen“ den Parameter p enthalten. Wie oft das der Fall sein soll, wird mittels der Vertrauenswahrscheinlichkeit (oder auch Konfidenzniveau) γ ausgedrückt. Das berechnete Intervall [pu, po] wird Konfidenzintervall (oder Vertrauensbereich) genannt. Oft wird γ gleich 95 % gewählt. Das bedeutet, dass bei Wiederholung des Verfahrens für 95 % aller Stichproben die Aussage p ∈ [pu, po] richtig ist.Clopper-Pearson-Intervall

Von C. Clopper und Egon Pearson (1934) stammt das folgende exakte Verfahren, um die untere Grenze pu und die obere Grenze po zu bestimmen.[2] Es sei, wie bisher, n die Größe der Stichprobe, k die Anzahl der Erfolge und das Konfidenzniveau sei 95 %.

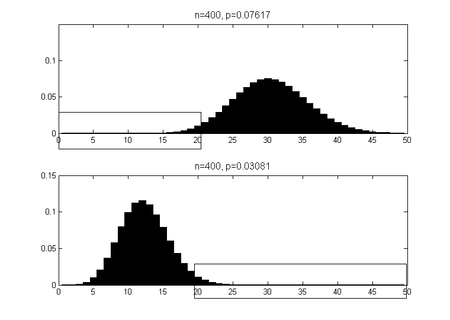

Die obere Grenze bestimmt man aus P(X ≤ k; po) = 0,025 und die untere Grenze aus P(X ≥ k; pu) = 0,025, siehe Abbildung.

Erläuterung: Wenn die Wahrscheinlichkeit, höchstens k Erfolge zu erzielen, für einen Anteilswert p die Grenze 0,025 unterschreitet, so kann bei einer Irrtumswahrscheinlichkeit von maximal 2,5 % ausgeschlossen werden, dass p der gesuchte Anteilswert ist. Somit ist po der größte Wert von p, bei dem beim gegebenen Konfidenzniveau noch angenommen werden kann, dass k oder weniger Erfolge auftreten. Für größere Werte von p erscheint dies zu unwahrscheinlich.

Für die untere Grenze gilt entsprechend: pu ist der kleinste Wert von p, bei dem noch angenommen wird, dass k oder mehr Erfolge auftreten können. Für kleinere Werte von p erscheint dies zu unwahrscheinlich, wobei auch hier die Irrtumswahrscheinlichkeit maximal 2,5 % beträgt. Somit liegt man in mindestens 95 % aller Fälle mit der Aussage „p ≤ po und p ≥ pu“ richtig.

Praktische Berechnung

Die beiden Werte pu, po lassen sich z.B. mit der Excel-Funktion BETAINV berechnen. Die Funktion gibt das Quantil der angegebenen Betaverteilung zurück und man erhält aufgrund des Zusammenhangs der Binomial- und Betaverteilung für die Auflösung der Gleichung P_p(X ≤ k) = α:

p = BETAINV(1-α;k+1;n-k). Im Folgenden bezeichnen wir wie bisher das Konfidenzniveau mit γ, außerdem sei α = 1-γ.Im Beispiel mit n = 400, k = 20 sowie Konfidenzniveau von 95 % erhält man so für die untere Grenze des Konfidenzintervalls:

P(X ≥ 20) = 0,025

P(X ≤ 19) = 0,975

pu = BETAINV(1 - 0,975; 20; 400 - 19) = 0,03081und für die obere Grenze des Konfidenzintervalls:

P(X ≤ 20) = 0,025

po = BETAINV(1 - 0,025; 21; 400 - 20) = 0,07617Erläuterung in Worten: Selbst bei einem Stimmenanteil von nur 3,1 % beträgt die Wahrscheinlichkeit, dass sich in der Stichprobe mindestens 20 Personen befinden, noch 2,5 %. Und entsprechend: sogar bei einem Stimmenanteil von 7,6 % beträgt die Wahrscheinlichkeit, dass sich in der Stichprobe höchstens 20 Personen befinden, noch 2,5 %

Die Methode ist in der folgenden Tabelle zusammengefasst:

allgemeiner Fall Sonderfall untere Grenze pu = BETAINV(α/2;k;n-k+1) pu=0 für k=0 obere Grenze po = BETAINV(1-α/2;k+1;n-k) po=1 für k=n Analyse der Überdeckungswahrscheinlichkeit

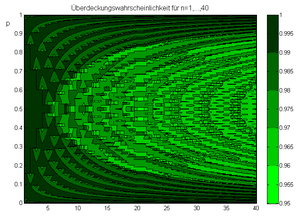

Ist C(k) das Konfidenzintervall zu k Erfolgen, so verlangt man laut Definition, dass für alle p die Überdeckungswahrscheinlichkeit

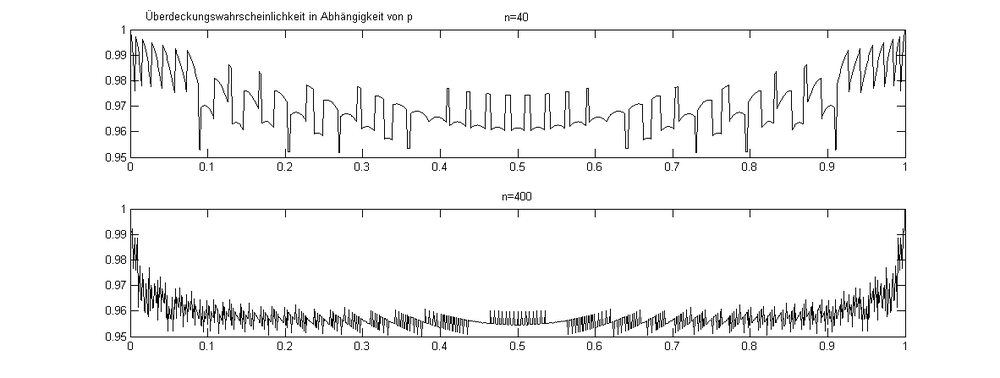

größer oder gleich 1 − γ ist. Bei stetigen Verteilungen lassen sich Konfidenzintervalle finden, so dass hier Gleichheit vorliegt (also = 1 - γ statt >= 1 - γ). Dies ist für die diskrete Binomialverteilung nicht möglich. In folgender Abbildung ist die Überdeckungswahrscheinlichkeit in Abhängigkeit von p dargestellt. Das Clopper-Pearson-Intervall wird übrigens deshalb exakt genannt, weil es eine Überdeckungswahrscheinlichkeit sicherstellt, die für alle p tatsächlich größer oder gleich dem geforderten Konfidenzniveau ist. Für die im Folgenden besprochenen Approximationen ist das nicht der Fall: hier gibt es oft Überdeckungswahrscheinlichkeiten, die kleiner sind als das geforderte Niveau!

größer oder gleich 1 − γ ist. Bei stetigen Verteilungen lassen sich Konfidenzintervalle finden, so dass hier Gleichheit vorliegt (also = 1 - γ statt >= 1 - γ). Dies ist für die diskrete Binomialverteilung nicht möglich. In folgender Abbildung ist die Überdeckungswahrscheinlichkeit in Abhängigkeit von p dargestellt. Das Clopper-Pearson-Intervall wird übrigens deshalb exakt genannt, weil es eine Überdeckungswahrscheinlichkeit sicherstellt, die für alle p tatsächlich größer oder gleich dem geforderten Konfidenzniveau ist. Für die im Folgenden besprochenen Approximationen ist das nicht der Fall: hier gibt es oft Überdeckungswahrscheinlichkeiten, die kleiner sind als das geforderte Niveau!Die Überdeckungswahrscheinlichkeit berechnet man in Abhängigkeit von p und n wie folgt:

![P_p ( k \in \{0,\ldots,n\} : p \in C(k)) = \sum_{k=0}^n B(k|p,n)\cdot \mathbf{1}_{[p_u(k), p_o(k)]}(p)](6/75621e6428d23e3fc5143d8e767b86d2.png) .

.

Hier ist

![\mathbf{1}_{[p_u(k), p_o(k)]}(p)](3/7d3eeb61d7cc042b8b49719555e0ebb4.png) die Indikatorfunktion. Sie nimmt den Wert 1 an, wenn p im Konfidenzintervall liegt, und sonst den Wert 0.

die Indikatorfunktion. Sie nimmt den Wert 1 an, wenn p im Konfidenzintervall liegt, und sonst den Wert 0.Einfache Approximation durch die Normalverteilung

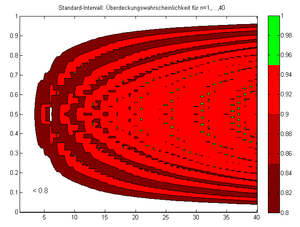

Oft verwendet man die folgende einfache Näherungsformel:[3]

welches auch Standard-Intervall genannt wird.

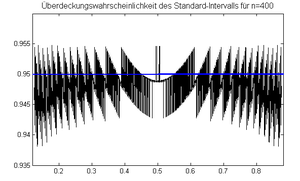

Wenn diese Formel verwendet wird, sollte k ≥ 50 und n - k ≥ 50 sein. Trotzdem kann die Verwendung des Standard-Intervalls problematisch sein. In der Abbildung ist z.B. die Überdeckungswahrscheinlichkeit für n=400 und

![p \in [0{,}125;0{,}875]](9/a89177f946ca2e76b0a46f888cd16b09.png) illustriert. Sie liegt oft unter dem geforderten Niveau von 0,95.

illustriert. Sie liegt oft unter dem geforderten Niveau von 0,95.Wilson-Intervall

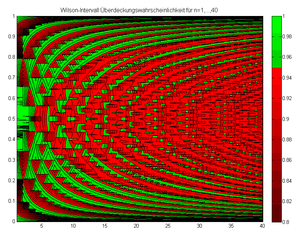

Dieses Intervall wurde 1927 von Edwin Bidwell Wilson vorgeschlagen und ist genauer als die einfache Approximation durch die Normalverteilung. Es gilt, mit dem gleichen c wie im vorigen Abschnitt,

Offenbar konvergieren die Intervallgrenzen für große n gegen die Grenzen des Standard-Intervalls (da c2 / 2n und c2 / 4n2 mit wachsendem n gegen Null gehen).

Durch Umformen erhält man die bei Brown/Cai/DasGupta auf Seite 107 angegebene Formel (4):

In der Abbildung ist die Überdeckungswahrscheinlichkeit für n=1,...,40 illustriert.

Die bei Henze auf Seite 228 angegebene Formel unterscheidet sich davon noch durch eine Stetigkeitskorrektur (von +0,5 oder -0,5 angewandt auf k).

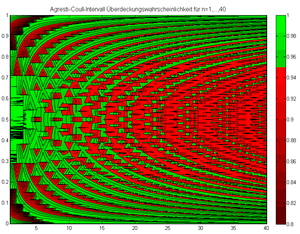

Agresti-Coull-Intervall

Für dieses Intervall setzt man

,

,  ,

,  und verwendet die (oben beschriebene) einfache Approximation mit diesen Parametern:

und verwendet die (oben beschriebene) einfache Approximation mit diesen Parametern:Der Mittelpunkt des Intervalls ist identisch zu dem des Wilson-Intervalls und das Intervall ist nie kürzer als ein Wilson-Intervall.[4]

Falls γ = 0,95, dann ist

und man bekommt eine einfache Regel:

und man bekommt eine einfache Regel:  ,

,  und

und  .

.Diskussion der Vor- und Nachteile der Verfahren

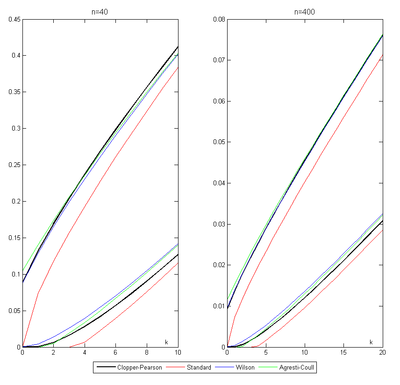

Die beschriebenen Methoden werden in dem grundlegenden Artikel von Brown/Cai/DasGupta verglichen. Dort wird das Standard-Intervall auch Wald-Intervall genannt (nach Abraham Wald). Brown/Cai/DasGupta empfehlen drei Intervall-Methoden: das Wilson-Intervall, das Agresti-Coull-Intervall und das Jeffreys-Intervall, welches wir hier nicht besprochen haben.[5] Für einen graphischen Vergleich der oberen und unteren Grenzen für die vier Methoden siehe auch die Abbildung am Anfang dieser Seite.

Literatur

- Agresti, Alan, und Coull, Brent A.: Approximate is better than 'exact' for interval estimation of binomial proportions, The American Statistician 52, 119-126 (1998)

- Brown, Lawrence D., Cai, T. Tony und Anirban DasGupta: Interval Estimation for a Binomial Proportion', Statistical Science 16 (2), 101–133 (2001) - pdf

- Clopper, C. und Pearson, E. S.: The use of confidence or fiducial limits illustrated in the case of the binomial, Biometrika 26, 404-413 (1934)

- Ross, T. D.: Accurate confidence intervals for binomial proportion and Poisson rate estimation, Computers in Biology and Medicine 33, 509-531 (2003)

- Wilson, E. B.: Probable inference, the law of succession, and statistical inference, Journal of the American Statistical Association 22, 209-212 (1927)

- Henze, Norbert: Stochastik für Einsteiger: Eine Einführung in die faszinierende Welt des Zufalls. 8. Auflage. Vieweg+Teubner Verlag 2010, ISBN 978-3-8348-0815-8, doi:10.1007/978-3-8348-9351-2.

- Krengel, Ulrich: Einführung in die Wahrscheinlichkeitstheorie und Statistik. 8. Auflage. Vieweg, 2005.

- Rinne, Horst: Taschenbuch der Statistik, Harri Deutsch (2003)

Einzelnachweise

- ↑ Die wichtigsten Methoden werden in dem grundlegenden Artikel von Brown/Cai/DasGupta verglichen. Außer den hier angegebenen wird dort noch z.B. das Jeffreys-Intervall besprochen.

- ↑ Siehe Krengel, Kapitel 4.7, Abschnitt Konfidenzintervalle für die Erfolgswahrscheinlichkeit

- ↑ Siehe hierfür und auch für die Clopper-Pearson- und Wilson-Intervalle Seite 459 des Taschenbuch der Statistik von Horst Rinne.

- ↑ Siehe Brown/Cai/DasGupta, S. 108

- ↑ Ihr Artikel wird ergänzt durch fünf Kommentare von (1) Alan Agresti und Brent A. Coull (2) George Casella (3) Chris Corcoran und Cyrus Mehta (4) Malay Ghosh (5) Thomas J. Santner und abgeschlossen durch eine Erwiderung von Brown/Cai/DasGupta.

Kategorien:- Schätztheorie

- Stochastik

Wikimedia Foundation.