- Kernel-Regression

-

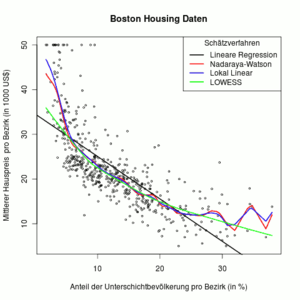

Unter Kernel-Regression versteht man eine Reihe nichtparametrischer statistischer Methoden, bei denen die Abhängigkeit einer zufälligen Größe von Ausgangsdaten mittels Kerndichteschätzung geschätzt werden. Die Art der Abhängigkeit, dargestellt durch die Regressionskurve, wird im Gegensatz zur linearen Regression nicht als linear festgelegt. Der Vorteil ist eine bessere Anpassung an die Daten im Falle nichtlinearer Zusammenhänge. Abhängig davon, ob die Ausgangsdaten selbst zufällig sind oder nicht, unterscheidet man zwischen Random-Design- und Fixed-Design-Ansätzen. Das grundlegende Verfahren wurde 1964 unabhängig voneinander von Geoffrey Watson und Elisbar Nadaraia (englische Transkription: Elizbar Nadaraya) vorgeschlagen.

Inhaltsverzeichnis

Univariate Kernel-Regression

Kerndichteschätzer

Ein Kerndichteschätzer

zur Bandweite h > 0 ist eine Schätzung der unbekannten Dichtefunktion f einer Variablen. Ist

zur Bandweite h > 0 ist eine Schätzung der unbekannten Dichtefunktion f einer Variablen. Ist  eine Stichprobe, K ein Kern, so ist die Kerndichteschätzung definiert als:

eine Stichprobe, K ein Kern, so ist die Kerndichteschätzung definiert als: .

.

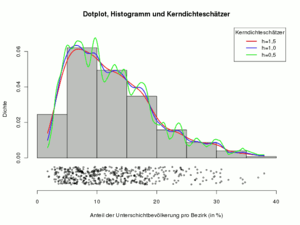

Wie die Grafik rechts zeigt, ist die Wahl der Bandbreite h entscheidend für die Qualität der Approximation.

Typische Kerne mit unbeschränktem Träger Träger [ − 1;1] Kern

Kern

Gauß

Uniform

Cauchy

Dreieck (1 − | u | ) Picard

Kosinus

Epanechnikov (p=1)

Quartic (p=2)

Triweight (p=3)Cp(1 − u2)p

Cp = 3 / 4

Cp = 15 / 16

Cp = 35 / 32Nadaraya-Watson-Schätzer

Der Nadaraya-Watson-Schätzer schätzt eine unbekannte Regressionsfunktion m(x) aus den Beobachtungsdaten (x1,y1),...,(xn,yn) als [1][2]

mit Kh(u) = 1 / hK(u / h) und einem Kern K und einer Bandweite h > 0. Die Funktion Kh ist dabei eine Funktion, die Beobachtungen nahe x ein großes Gewicht und Beobachtungen weit entfernt von x ein kleines Gewicht zuordnet. Die Bandweite legt fest, in welchem Bereich um x die Beobachtungen ein großes Gewicht haben.

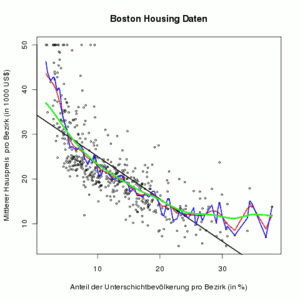

Während die Wahl des Kerns meist recht frei erfolgen kann, hat die Wahl der Bandweite einen großen Einfluss auf die Glattheit des Schätzers. Die Grafik rechts zeigt, dass eine große Bandweite (grün) zu einer glatteren Schätzung führt als die Wahl einer kleinen Bandweite (blau).

Ableitung

Die Idee des Nadaraya-Watson-Schätzers beruht darauf, dass die unbekannte Regressionsfunktion

- Y = m(X)

mit Hilfe des bedingten Erwartungswertes durch die gemeinsame Dichte f(x,y) und die Randdichte fX(x) dargestellt wird.

Die unbekannten Dichten f(x,y) und fX(x) werden mit Hilfe einer Kerndichteschätzung geschätzt. Zur Berechnung der gemeinsamen Dichte aus den Beobachtungen wird ein bivariater Kerndichteschätzer mit Produktkern K(x,y) = K(x)K(y) und Bandweiten g und h genutzt:

.

.

Es folgt

und mittels Kerndichteschätzung für fX(x) der Nadaraya-Watson-Schätzer.

Eigenschaften

1. Wie im Fall der linearen Regression kann der Nadaraya-Watson-Schätzer auch als Linearkombination der yi mit Gewichtsfunktionen Whi geschrieben werden:

.

.

Damit ist der Nadaraya-Watson-Schätzer das (lokal) gewichtete Mittel der Beobachtungswerte yi, es gilt

.

.

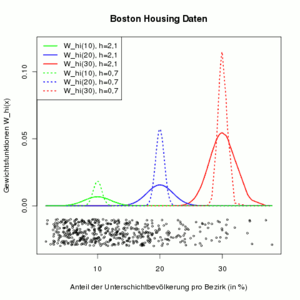

Die Grafik rechts zeigt die Gewichte für verschiedene Werte von x (blau: x = 10, grün: x = 20, rot: x = 30). Der Dotplot unterhalb von Null zeigt die Daten der erklärenden Variable. Je größer die Bandweite ist (durchgezogene Linie vs. gestrichelte Linie), desto mehr Beobachtungen um x haben ein Gewicht ungleich Null. Je weniger Daten zu Verfügung stehen (rechts), desto stärker müssen die verfügbaren Beobachtungen gewichtet werden.

2. Die mittlere quadratische Abweichung ergibt sich approximativ als

mit B und V unabhängig von n und h. Damit ist die Konvergenz langsamer als bei der linearen Regression, d.h. mit der gleichen Zahl von Beobachtungen kann der Vorhersagewert in der linearen Regression präziser geschätzt werden als beim Nadaraya-Watson-Schätzer.

Dabei ist die Verzerrung des Nadaraya-Watson-Schätzers

mit m'(x) und m''(x) die erste bzw. zweite Ableitung der unbekannten Regressionsfunktion, f'X(x) die erste Ableitung der Dichte fX(x) und

.

.Und die Varianz des Schätzers

mit σ2(x) = Var(Y | X = x) und

.

.Bandweitenwahl

Das Hauptproblem bei der Kernel-Regression ist die Wahl einer geeigneten Bandweite h. Als Basis dient die Minimierung der mittlere quadratische Abweichung

bzw. deren Approximation. Die Approximation enthält jedoch die zweite Ableitung der unbekannten Regressionsfunktion m''(x) sowie die unbekannte Dichtefunktion fX(x) und deren Ableitung. Stattdessen wird die datenbasierten gemittelte quadratische Abweichung

minimiert. Da zur Schätzung von

der Wert von yi genutzt wird, führt eine Bandweite h = 0 zu einem

der Wert von yi genutzt wird, führt eine Bandweite h = 0 zu einem  (Resubstitution Schätzung). Daher wird eine Leave-One-Out-Kreuzvalidierung durchgeführt, d.h. zur Berechnung des Schätzwertes

(Resubstitution Schätzung). Daher wird eine Leave-One-Out-Kreuzvalidierung durchgeführt, d.h. zur Berechnung des Schätzwertes  werden alle Beobachtungen herangezogen außer der i-ten. Damit wird der

werden alle Beobachtungen herangezogen außer der i-ten. Damit wird der  für verschiedene Bandweiten berechnet. Die Bandweite, die einen minimalen ASE ergibt wird dann zur Schätzung der unbekannten Regressionfunktion genommen.

für verschiedene Bandweiten berechnet. Die Bandweite, die einen minimalen ASE ergibt wird dann zur Schätzung der unbekannten Regressionfunktion genommen.Konfidenzbänder

Nach der Schätzung der Regressionsfunktion

stellt sich die Frage, wie weit diese von der wahren Funktion m(x) abweicht. Die Arbeit von Bickel und Rosenblatt (1973)[3] liefert zwei Theoreme für punktweise Konfidenzbänder und gleichmässige Konfidenzbänder.

stellt sich die Frage, wie weit diese von der wahren Funktion m(x) abweicht. Die Arbeit von Bickel und Rosenblatt (1973)[3] liefert zwei Theoreme für punktweise Konfidenzbänder und gleichmässige Konfidenzbänder.Neben der Information über die Abweichung zwischen

und m(x) liefern die Konfidenzbänder einen Hinweis darauf, ob ein mögliches parametrisches Regressionsmodell, z.B. eine lineare Regression, zu den Daten passt. Liegt der geschätzte Verlauf der Regressionfunktion des parametrisches Regressionsmodell außerhalb der Konfidenzbänder, so ist dies ein Hinweis darauf, dass das parametrische Regressionsmodell nicht zu den Daten passt. Ein formaler Test ist mit Hilfe von Bootstrap-Verfahren möglich.

und m(x) liefern die Konfidenzbänder einen Hinweis darauf, ob ein mögliches parametrisches Regressionsmodell, z.B. eine lineare Regression, zu den Daten passt. Liegt der geschätzte Verlauf der Regressionfunktion des parametrisches Regressionsmodell außerhalb der Konfidenzbänder, so ist dies ein Hinweis darauf, dass das parametrische Regressionsmodell nicht zu den Daten passt. Ein formaler Test ist mit Hilfe von Bootstrap-Verfahren möglich.Punktweise Konfidenzbänder: Unter bestimmten Voraussetzungen konvergiert in Verteilung

mit h = cn1 / 5,

und

und  .

.Wenn die Bandweite klein genug ist, dann kann der asymptotische Bias B(x) vernachlässigt werden gegen die asymptotische Varianz V(x). Damit können approximative 1 − α Konfidenzbänder berechnet werden

mit z1 − α / 2 das 1 − α / 2 Quantil der Standardnormalverteilung. Die unbekannte Dichte fx(x) wird dabei mit einer Kerndichteschätzung

geschätzt und σ2(x) mit

geschätzt und σ2(x) mit .

.

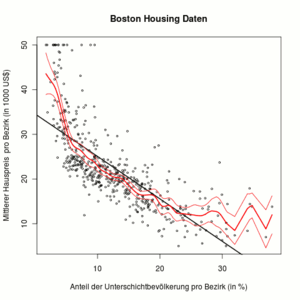

Die Grafik rechts zeigt den Nadaraya-Watson Schätzer mit punktweisen 95% Konfidenzband (rote Linien). Die schwarze lineare Regressionsgerade liegt in verschiedenen Bereichen deutlich außerhalb der Konfidenzbandes. Dies ist ein Hinweis darauf, dass ein lineares Regressionsmodell hier nicht angemessen ist.

Gleichmässige Konfidenzbänder: Unter etwas stärkeren Voraussetzungen als zuvor und mit

![x\in[0;1]](9/3a97c90273f0b5ce2008459a60911081.png) , h = n − κ mit 1 / 5 < κ < 1 / 2 und für Kerne mit Träger in [ − 1;1] konvergiert

, h = n − κ mit 1 / 5 < κ < 1 / 2 und für Kerne mit Träger in [ − 1;1] konvergiertmit

.

.

Die Bedingung

![x\in[0;1]](9/3a97c90273f0b5ce2008459a60911081.png) ist keine Einschränkung, da die Daten xi erst auf das Intervall [0;1] transformiert werden können. Danach wird das Konfidenzband berechnet und wieder zurücktransformiert auf die Originaldaten.

ist keine Einschränkung, da die Daten xi erst auf das Intervall [0;1] transformiert werden können. Danach wird das Konfidenzband berechnet und wieder zurücktransformiert auf die Originaldaten.Gasser-Müller-Schätzer

Im Fixed-Design-Fall mit

ist die Dichte fX(x) bekannt, muss also nicht geschätzt werden. Dies vereinfacht sowohl die Berechnungen als auch die mathematische Behandlung des Schätzers. Für diesen Fall wurde der Gasser-Müller-Schätzer definiert als[4]

ist die Dichte fX(x) bekannt, muss also nicht geschätzt werden. Dies vereinfacht sowohl die Berechnungen als auch die mathematische Behandlung des Schätzers. Für diesen Fall wurde der Gasser-Müller-Schätzer definiert als[4]mit

und s0 = a, sn + 1 = b und si = (xi + xi − 1) / 2.

Eigenschaften

1. Der Gasser-Müller Schätzer ist wie der Nadaraya-Watson-Schätzer ein linearer Schätzer und die Summe der Gewichtsfunktionen ist Eins.

2. Für die mittlere quadratische Abweichung gilt:

.

.Lokal polynomiale Kernel-Regression

Der Nadaraya-Watson Schätzer kann als Lösung des folgenden lokalen Minimierungsproblem geschrieben werden:

,

,

d.h. für jedes x wird ein lokal konstanter Wert

bestimmt, der gleich dem Wert des Nadaraya-Watson Schätzer

bestimmt, der gleich dem Wert des Nadaraya-Watson Schätzer  an der Stelle x ist.

an der Stelle x ist.Anstelle einer lokalen Konstanten kann auch ein Polynom verwendet werden:

,

,

d.h. der unbekannten Regressionswert wird durch eine lokales Polynom approximiert. Die lokal polynomiale Kernel-Regression mp(x) ergibt sich an jeder Stelle durch

.

.

Die Grafik rechts zeigt an ausgewählten Stellen x die verwendeten lokalen Polynome. Der Nadaraya-Watson Schätzer (rot) nutzt lokal konstanten Funktionen

. Die lokal lineare Kernel-Regression (blau) nutzt lokal lineare Funktionen

. Die lokal lineare Kernel-Regression (blau) nutzt lokal lineare Funktionen  an der Stelle x. Die ausgewählten Stellen x sind in der Grafik mit Datenpunkten identisch. Die senkrechten grauen Linien verbinden die lokalen Polynome mit dem zugehörigen x-Wert (Datenpunkt). Der Schnittpunkt mit dem roten bzw. blauen Polynom ergibt den Schätzwert an der entsprechenden Stelle x für den Nadaraya-Watson Schätzer und die lokal lineare Kernel-Regression.

an der Stelle x. Die ausgewählten Stellen x sind in der Grafik mit Datenpunkten identisch. Die senkrechten grauen Linien verbinden die lokalen Polynome mit dem zugehörigen x-Wert (Datenpunkt). Der Schnittpunkt mit dem roten bzw. blauen Polynom ergibt den Schätzwert an der entsprechenden Stelle x für den Nadaraya-Watson Schätzer und die lokal lineare Kernel-Regression.Vorteile und Eigenschaften

Die lokal polynomiale Regression bietet gegenüber dem Nadaraya-Watson Schätzer einige Vorteile:

- Im allgemeinen wird das lokal konstante

von Beobachtungswerten beeinflusst die sowohl links als auch rechts vom Wert x liegen. An den Rändern funktioniert das jedoch nicht und dies führt zu boundary effects. Die lokal polynomiale Kernel-Regression approximiert jedoch lokal mit einem Polynom und kann dieses Problem vermeiden.

von Beobachtungswerten beeinflusst die sowohl links als auch rechts vom Wert x liegen. An den Rändern funktioniert das jedoch nicht und dies führt zu boundary effects. Die lokal polynomiale Kernel-Regression approximiert jedoch lokal mit einem Polynom und kann dieses Problem vermeiden. - Um die vte Ableitung zu schätzen, könnte man einfach den Nadaraya-Watson entsprechend oft ableiten. Mit der lokal polynomialen Kernel-Regression ergibt sich jedoch ein deutlich eleganterer Weg:

-

- Meist wird p = v + 1 oder p = v + 3 benutzt. Ungerade Ordnungen p sind besser als gerade Ordnungen.

- Wie im Fall der linearen Regression und des Nadaraya-Watson-Schätzer kann auch die lokal polynomiale Kernel-Regression auch als Linearkombination der yi mit Gewichtsfunktionen

geschrieben werden:

geschrieben werden:

.

.

Schätzung der Beta-Koeffizienten

Definiert man die folgenden Matrizen:

,

,

und

so ergeben sich die Schätzung der Beta-Koffizienten

als

als .

.

Die für die Ableitung notwendigen Koeffizienten werden im Schätzverfahren also automatisch mit berechnet!

Um die Schätzung praktisch durchzuführen, berechnet man

und berechnet

Lokal lineare Kernel-Regression

Einer der bekannteste lokal linearen Regressionsmodelle (p = 1) ist der LOESS oder LOWESS (engl. Abkürzung von locally weighted scatterplot smoothing).[5] Der LOWESS ist jedoch keine lokal-lineare Kernel-Regression, denn

- die Regressionsgewichte werden robust geschätzt und

- die Bandweite variiert mit x.

Die Grafik rechts zeigt zwei verschiedene Methoden der Kernel-Regression: Lokal konstant (rot, Nadaraya-Watson) und lokal linear (blau). Insbesondere an den Rändern approximiert die lokal lineare Kernel-Regression die Daten etwas besser.

Die lokal lineare Kernel-Regression ergibt sich als

.

.

Der mittlere quadratische Fehler der lokal linearen Regression ergibt sich, wie beim Nadaraya-Watson-Schätzer, als

mit

und die Varianz ist identisch zur Varianz des Nadaraya-Watson-Schätzers

. Die einfachere Form des Bias macht die lokal linearen Kernel-Regression attraktiver für praktische Zwecke.

. Die einfachere Form des Bias macht die lokal linearen Kernel-Regression attraktiver für praktische Zwecke.Einzelnachweise

- ↑ Elizbar A. Nadaraya: On estimating regression. In: Theory of Probability and its Applications. 9, Nr. 1, 1964, S. 141-142, doi:10.1137/1109020.

- ↑ Geoffrey S. Watson: Smooth Regression Analysis. In: Sankhyā: The Indian Journal of Statistics, Series A. 26, Nr. 4, Dezember 1964, S. 359-372.

- ↑ Bickel, Rosenblatt (1973) On some global measures of the deviations of density function estimators, Annals of Statistics 1, S. 1071-1095

- ↑ Theo Gasser, Hans-Georg Müller: Estimating Regression Functions and Their Derivatives by the Kernel Method. In: Scandinavian Journal of Statistics. 11, Nr. 3, 1984, S. 171-185.

- ↑ W.S. Cleveland: Robust Locally Weighted Regression and Smoothing Scatterplots. In: Journal of the American Statistical Association. 74, Nr. 368, Dezember 1979, S. 829-836 (http://jstor.org/stable/2286407).

Literatur

- Jianqing Fan, Irene Gijbels: Local Polynomial Modelling and Its Applications. Chapman and Hall/CRC, 1996, ISBN 978-0412983214.

- Wolfgang Härdle, Marlene Müller, Stefan Sperlich, Axel Werwatz: Nonparametric and Semiparametric Models. Springer Verlag, Berlin, Heidelberg 2004, ISBN 978-3540207221 (http://fedc.wiwi.hu-berlin.de/xplore/ebooks/html/spm).

- Tristen Hayfield, Jeffrey S. Racine: Nonparametric Econometrics: The np Package. In: Journal of Statistical Software. 27, Nr. 5, 2008 (http://www.jstatsoft.org/v27/i05/).

- M.P. Wand, M.C. Jones: Kernel Smoothing. Chapman and Hall/CRC, 1994, ISBN 978-0412552700.

Wikimedia Foundation.