- Expectation-Maximization-Algorithmus

-

Der Expectation-Maximization-Algorithmus (kurz EM-Algorithmus, selten auch Estimation-Maximization-Algorithmus) ist ein Algorithmus der mathematischen Statistik.

Der EM-Algorithmus wird vorrangig zur Ballungsanalyse verwendet (Siehe hierzu den Abschnitt „EM-Algorithmus“ im Artikel Clusteranalyse).

Inhaltsverzeichnis

Funktionsweise

Es liegen Objekte mit einer gewissen Anzahl von Eigenschaften vor. Die Eigenschaften nehmen zufällige Werte an. Einige Eigenschaften können gemessen werden, andere jedoch nicht. Formal gesehen sind die Objekte Instanzen einer mehrdimensionalen Zufallsvariablen X, die einer unbekannten Wahrscheinlichkeitsverteilung p(x) unterliegt; einige Dimensionen sind „beobachtbar“, andere sind „versteckt“. Ziel ist es, die unbekannte Wahrscheinlichkeitsverteilung zu bestimmen.

Zunächst nimmt man an, p(x) sei bis auf einige Parameter bekannt. Meist wählt man p als Mischverteilung, also als gewichtete Summe von so vielen Standardverteilungen, wie beobachtbare Eigenschaften vorliegen. Wählt man beispielsweise als Standardverteilung die Normalverteilung, so sind die unbekannten Parameter jeweils der Mittelwert μ und die Varianz σ2. Ziel ist es nun, die Parameter Θ der vermuteten Wahrscheinlichkeitsverteilung zu bestimmen. Wählt man eine Mischverteilung, so enthält Θ auch die Gewichtungsfaktoren der Summe.

Für gewöhnlich geht man ein solches Problem mit der Maximum-Likelihood-Methode an. Dies ist hier jedoch nicht möglich, da die gesuchten Parameter von den versteckten Eigenschaften abhängen – und diese sind unbekannt. Um trotzdem zum Ziel zu kommen, wird also eine Methode benötigt, die gleichzeitig mit den gesuchten Endparametern die versteckten Parameter schätzt. Diese Aufgabe erfüllt der EM-Algorithmus.

Der EM-Algorithmus arbeitet iterativ und führt in jedem Durchgang zwei Schritte aus:

- Versteckte Parameter Y schätzen. Zunächst werden die versteckten Parameter aus den im vorherigen Durchgang bestimmten Endparametern Θ und den beobachteten Daten X geschätzt. Dazu wird die sogenannte Q-Funktion verwendet, die einen vorläufigen Erwartungswert der gesuchten Verteilung berechnet.

- Endparameter Θ bestimmen. Jetzt, wo die versteckten Parameter abgeschätzt sind, wird die Maximum-Likelihood-Methode angewandt, um die eigentlich gesuchten Parameter zu bestimmen.

Der Algorithmus endet, wenn sich die bestimmten Parameter nicht mehr wesentlich ändern.

Bewiesenermaßen konvergiert die Folge der bestimmten Θ, d. h. der Algorithmus terminiert auf jeden Fall. Zudem bilden die bestimmten Parameter Θ ein lokales Optimum; das bedeutet, sie sind im Allgemeinen gut, es könnte jedoch unter Umständen (viel) bessere geben.

Formulierung als Zufallsexperiment

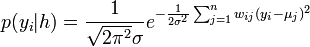

Rein formal wird beim EM-Algorithmus angenommen, dass die Werte der beobachteten stochastischen Größe auf folgende Art und Weise zustandekommen: Wähle zuerst eine der eingehenden Zufallsvariablen aus und übernimm deren Wert als Endergebnis. Das bedeutet, dass genau ein Gewicht den Wert eins annimmt und alle anderen null sind. Bei der Approximation der Gewichte durch den EM-Algorithmus ist dies normalerweise aber nicht mehr der Fall. Die Wahrscheinlichkeitsdichte eines Zielwertes lässt sich bei Normalverteilungsannahme und konstanter Varianz der einzelnen Zufallsvariablen darstellen als:

Dabei besitzen die verwendeten Bezeichnungen folgende Bedeutungen:

- wij: Gewicht der j-ten Zufallsvariable für den i-ten Wert der Zielgröße

- n: Anzahl der Gewichte

- yi: Wert der i-ten Zielgröße

- h: Stichprobe

- μj: Erwartungswert der j-ten Zufallsvariable

- σ2: Varianz

Lösungsverfahren

Der EM-Algorithmus besteht aus mehreren Iterationen der Schritte Expectation und Maximization.

- Im ersten Schritt muss das μ frei gewählt werden. Nehme dazu an, dass genau eine beliebige Zufallsvariable (genau eine beliebige Trainingsinstanz yk) diesem Erwartungswert μ entspricht, d.h. setze μ1,appr = yk. Die beiden folgenden Schritte nähern sich dann iterativ dem tatsächlichen μ an.

- Im Expectation-Schritt werden die Erwartungswerte der Gewichte berechnet unter der Annahme, dass die Erwartungswerte der eingehenden Zufallsvariablen den in Schritt zwei berechneten entsprechen. Dies ist allerdings nur möglich, falls es sich nicht um die erste Iteration handelt.

Die Erwartungswerte lassen sich darstellen als

![E[w_{ij}]=p(X_j=y_i |\mu _j = \mu _{j,\mathrm{appr}})/ \sum _{k=1}^n p(X_k=y_i|\mu_k = \mu_{k,\mathrm{appr}})](/pictures/dewiki/51/31991aa0142ef4eb5cb76851de06f731.png)

- Im Maximization-Schritt werden die Erwartungswerte der Wahrscheinlichkeitsverteilungen der einzelnen Zufallsvariablen bestimmt, bei denen die Wahrscheinlichkeit für das Eintreffen des Stichprobenergebnisses maximiert wird. Dies geschieht unter der Annahme, dass die exakten Werte der Gewichte jeweils ihren Erwartungswerten entsprechen. (Maximum-Likelihood-Algorithmus). Die auf diese Weise geschätzten Erwartungswerte ergeben sich bei Normalverteilungsannahme durch

![\mu_{j,\mathrm{appr}}=\frac{1}{n} \sum_{i=1}^n E[w_{ij}] y_i](/pictures/dewiki/98/b0df037725eea3d478564d78c57dba05.png)

Vorteile

- Kann mit unvollständigen Beobachtungen umgehen

Instanzen des EM-Algorithmus

- Schätzen der Parameter einer Mischverteilung

- Baum-Welch-Algorithmus zum Schätzen der Parameter eines Hidden-Markov-Modells

- K-Means-Algorithmus zum k-Partitionieren von Daten

- …

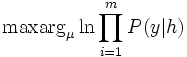

Beweis für den Maximization-Schritt bei Normalverteilungsannahme

Bewiesen werden soll:

![\mathrm{maxarg}_{\mu_k}\prod_{i=1}^m P\left( y|h \right)

=^? \frac{1}{m} \sum_{i=1}^{m} \frac{1}{2\sigma ^2} E[w_{ik}] y_i](/pictures/dewiki/54/67879e3cd2919c27e03820967fee8429.png)

Anstatt P(y | h) zu maximieren, kann auch lnP(y | h) maximiert werden, da der Logarithmus eine streng monoton steigende Funktion ist.

![= \mathrm{maxarg}_{\mu} \left( \sum_{i=1}^m

\left( \ln \frac{1}{\sqrt{2\pi^2}}

- \sum_{j=1}^n \frac{1}{2\sigma ^2} E[w_{ij}] (y_i-\mu_j)^2 \right) \right)](/pictures/dewiki/51/3249cf6e56028afe966d6596ffebf874.png)

![= \mathrm{maxarg}_{\mu} \left( m \ln \frac{1}{\sqrt{2\pi^2}}

- \frac{1}{2\sigma^2} \sum_{i=1}^m \sum_{j=1}^n E[w_{ij}] (y_i-\mu_j)^2 \right)](/pictures/dewiki/97/afb503d216c298d361724862bf2f37ec.png)

Der Minuend ist eine Konstante, deswegen ist es ausreichend, den Subtrahend zu minimieren:

![\mathrm{minarg}_{\mu} \left( \frac{1}{2\sigma^2} \sum_{i=1}^m \sum_{j=1}^n E \left[w_{ij} \right] \left(y_i-\mu_j \right)^2 \right)=](/pictures/dewiki/53/5fa5e130d90fbeb2c70db33c79bb59c9.png)

![\mathrm{minarg}_{\mu} \left(\sum_{i=1}^m \sum_{j=1}^n E[w_{ij}] (y_i-\mu_j)^2 \right)](/pictures/dewiki/49/180e04ee5dd0e6e179832e7a73720977.png)

Eine quadratische Summe ergibt stets einen nichtnegativen Wert. Daher ist das absolute Minimum durch 0 beschränkt und somit auch ein lokales Minimum. Man setze die 1. Ableitung für diesen Term t nach jedem μk auf 0:

![\frac{\mathrm{d}t}{\mathrm{d}\mu_k} = -2\sum_{i=1}^m E \left[w_{ik} \right] \left(y_i-\mu_k \right) = 0](/pictures/dewiki/51/3f87ccc037c0592c7008cefc442eab4c.png) ,

,denn die Ableitung aller Summanden der Summe über j sind 0, außer für j=k. Folglich:

![\sum_{i=1}^m E[w_{ik}] y_i= m\mu_k \quad \Rightarrow \quad

\mu_k=\frac{1}{m} \sum_{i=1}^m E\left[w_{ik} \right] y_i](/pictures/dewiki/57/9068df121804723b80a91ff6e91e4b25.png)

q.e.d.

Literatur

- Dempster, A.P., Laird. N.M., Rubin, D.B.: Maximum-Likelihood from incomplete data via the EM algorithm. Journal of the Royal Statistical Society, 1977

- Mitchell, Tom M.: Machine Learning. The Mc-Graw-Hill Companies, Inc., 1997

- Duda et al.: Pattern Classification. John Wiley & Sons, Inc.

Wikimedia Foundation.