- Technologische Singularität

-

In der Futurologie bezeichnet technologische Singularität den Zeitpunkt, ab dem Maschinen sich mittels künstlicher Intelligenz selbst verbessern können und so den technischen Fortschritt massiv beschleunigen.

Inhaltsverzeichnis

Inhalt der Theorie

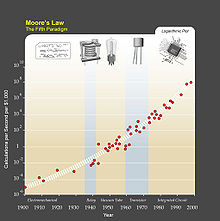

Exponentielle Leistungsentwicklung im Verlauf der Computergeschichte

Exponentielle Leistungsentwicklung im Verlauf der Computergeschichte

Ausgangspunkt für die Theorie der technologischen Singularität ist die These, dass sich Technik und Wissenschaft seit Anbeginn der Menschheit immer rascher weiterentwickeln und viele zahlenmäßige Entwicklungen wie Bevölkerungs-, Wissens-, und Wirtschaftsentwicklung einem raschen exponentiellen Wachstum zu folgen scheinen. Dazu zählt auch die Rechenleistung von Computern: Laut einer Prognose Gordon Moores verdoppelt sich die für 1.000 US-Dollar erhältliche Rechenleistung alle 18 Monate. Dem rasanten technischen Fortschritt steht die anscheinend konstant bleibende Leistungsfähigkeit des durchschnittlichen menschlichen Geistes gegenüber. Hans Moravec bezifferte die Rechenleistung des Gehirns auf 100 Teraflops, Raymond Kurzweil auf 10.000 Teraflops. Diese Rechenleistung haben Supercomputer bereits erreicht. Auch wenn man der menschlichen Denkfähigkeit eine höhere Rechenleistung zuordnet, ist es nach diesem Modell nur eine Frage der Zeit, bis Computer die Rechenleistung des menschlichen Gehirns überflügeln.

Es ist schwierig, die Rechenleistung von Mensch und Computer zu vergleichen. Folgendes Beispiel kann einen Ansatzpunkt zeigen. Heutige Desktopcomputer reichen aus, um eine grundlegende Spracherkennungsfunktion zu realisieren. Im menschlichen Gehirn machen Regionen, die zur Spracherkennung verwendet werden, ca. 0,01% des Gesamtgehirns aus. Lässt sich die restliche menschliche Intelligenz ebenso gut in Algorithmen umsetzen, fehlen nur wenige Größenordnungen, bis Computer die Denkfähigkeit von Menschen erreichen. [1]

Das bloße Übertreffen der Rechenleistung sagt jedoch nichts darüber aus, wie und zu welchem Zweck die technische Mehrleistung verwendet wird. Als weitere Grundbedingung für eine Singularität kommt daher die starke künstliche Intelligenz hinzu, ein künstliches System, das kreativ über Probleme nachdenken kann. Laut Theorie ist eine starke künstliche Intelligenz mit mehr Rechenleistung als das menschliche Gehirn eine sogenannte Superintelligenz, also intelligenter als der Mensch selbst, und kann damit Technik und Wissenschaft noch schneller vorantreiben. Vielleicht könnte sie dadurch weitere künstliche Systeme schaffen, die noch intelligenter sind; es käme zu einer Rückkopplung und einem derart rasanten technischen Fortschritt, dass die Menschen verstandesmäßig nicht mehr folgen können.

Neben künstlicher Intelligenz werden auch andere Technologien gehandelt, die zu einer technologischen Singularität führen könnten: Technische Implantate mit Gehirn-Computer-Schnittstellen oder Gentechnik könnten die Leistungsfähigkeit des menschlichen Geistes derart steigern, dass Menschen ohne diese Ausrüstung der Entwicklung nicht mehr folgen könnten. Diese Szenarien werden in der Futurologie unter dem Begriff „erweiterte Intelligenz” (engl. augmented intelligence) geführt.

Geschichte

Frühe Erwähnungen

Die erste bekannte Erwähnung des Konzepts einer Singularität geht auf Stanislaw Ulam zurück, der sich im Mai 1958 folgendermaßen zu einer Unterhaltung mit John von Neumann äußerte:

„Ein Gespräch drehte sich um den sich stets beschleunigenden technologischen Fortschritt und um die Veränderungen in der Art und Weise menschlichen Lebens, die den Anschein machen, auf eine unumgängliche Singularität in der Geschichte der Menschheit hinauszulaufen, nach der das Leben der Menschen, so wie wir es kennen, nicht weitergehen kann.“

1965 beschrieb der Statistiker I. J. Good ein Konzept, das der heute vorherrschenden Bedeutung von Singularität insofern noch näher kam, als es die Rolle künstlicher Intelligenz mit einbezog:

„Eine ultraintelligente Maschine sei definiert als eine Maschine, die die intellektuellen Fähigkeiten jedes Menschen, und sei er noch so intelligent, bei weitem übertreffen kann. Da der Bau eben solcher Maschinen eine dieser intellektuellen Fähigkeiten ist, kann eine ultraintelligente Maschine noch bessere Maschinen bauen; zweifellos würde es dann zu einer explosionsartigen Entwicklung der Intelligenz kommen, und die menschliche Intelligenz würde weit dahinter zurückbleiben. Die erste ultraintelligente Maschine ist also die letzte Erfindung, die der Mensch zu machen hat.“

Auch die 1970 erschienene wirtschaftliche Trendanalyse Future Shock von Alvin Toffler bezog sich auf die Singularität.

Vernor Vinge

In den 80er Jahren begann der Mathematiker und Autor Vernor Vinge von einer Singularität zu sprechen, 1993 veröffentlichte er seine Ideen in dem Artikel Technological Singularity. Daraus stammt auch die häufig zitierte Prognose, dass wir „innerhalb von 30 Jahren über die technologischen Mittel verfügen werden, um übermenschliche Intelligenz zu schaffen. Wenig später ist die Ära der Menschen beendet.“ Vinge schreibt, dass übermenschliche Intelligenz, unabhängig davon, ob durch kybernetisch erweiterte menschliche Intelligenz oder durch künstliche Intelligenz erreicht, wiederum noch besser dazu in der Lage sein wird, ihre Intelligenz zu steigern. „Wenn Fortschritt von übermenschlicher Intelligenz vorangetrieben wird“, so Vinge, „wird dieser Fortschritt deutlich schneller ablaufen.“ Diese Art von Rückkopplung soll zu enormem Fortschritt in sehr kurzer Zeit führen.

Ray Kurzweil

In dem 2001 veröffentlichten Artikel The Law of Accelerating Returns stellt Raymond Kurzweil die These auf, dass das Mooresche Gesetz nur ein Spezialfall eines allgemeineren Gesetzes ist, nach dem die gesamte technologische Evolution verläuft.[2]

Betrachtet man die Entwicklung von mechanischen Rechenmaschinen, über Röhren und Transistoren bis zum heutigen Mikroprozessor, so zeige dies eine doppelt exponentielle Steigerung der Leistungsfähigkeit. Die Rechenleistung pro 1000 Dollar verdoppelte sich in den Jahren 1910 bis 1950 im Abstand von drei Jahren (mechanische Rechenmaschinen), von 1950 bis 1966 etwa alle zwei Jahre und jetzt etwa jährlich. Ray Kurzweil glaubt, dass das durch das Mooresche Gesetz beschriebene exponentielle Wachstum sich auch in den Technologien fortsetzen wird, die die heutigen Mikroprozessoren ablösen werden, und letztendlich zur Singularität führen wird, die er als „technischen Wandel“ definiert, der „so schnell und allumfassend ist, dass er einen Bruch in der Struktur der Geschichte der Menschheit darstellt.“

Technologien

Zukunftsforscher erwägen verschiedene Technologien, die für die Herbeiführung einer Singularität eine Rolle spielen könnten. Über die Reihenfolge, in der diese Technologien Wirklichkeit werden könnten, besteht keine Einigkeit, ebenso wenig über die Verwirklichbarkeit der meisten Ideen.

Künstliche Intelligenz

Eine künstliche Intelligenz, die die Fähigkeit besitzt, sich rekursiv zu verbessern und so das Stadium menschlicher Intelligenz zu erreichen und zu überschreiten, wird als Seed AI bezeichnet. Viele Anhänger der Singularität sind der Meinung, dass eine Seed AI die wahrscheinlichste Möglichkeit ist, eine Singularität herbeizuführen. Das Singularity Institute for Artificial Intelligence wurde zu diesem Zweck gegründet.

Nanotechnologie

Viele Anhänger der Singularität halten von Menschen kontrollierte Nanotechnologie für eine der größten Bedrohungen der Zukunft der Menschheit (Grey Goo). Aus diesem Grund fordern einige, dass molekulare Nanotechnologie nicht vor Auftreten einer Seed AI praktiziert wird.

Von dem Foresight Institute wird dagegen die Meinung vertreten, dass ein verantwortungsvoller Umgang mit dieser Technologie auch in Präsingularitätszeiten möglich ist und die Realisierung einer für die Menschheit positiven Singularität dadurch beschleunigt werden kann.

Andere Technologien

Neben künstlicher Intelligenz und Nanotechnologie wurden auch andere Technologien mit der Singularität in Zusammenhang gebracht: Direkte Gehirn-Computer-Schnittstellen, die zu dem Bereich Augmented Intelligence gezählt werden, könnten zu verbessertem Gedächtnis, umfangreicherem Wissen oder größerer Rechenkapazität unseres Gehirns führen. Auch Sprach- und Handschrifterkennung, leistungssteigernde Medikamente und gentechnische Methoden können hierzu gezählt werden.

Als alternative Methode zur Schaffung künstlicher Intelligenz wurde, in erster Linie von Science-Fiction-Autoren wie Roger Zelazny, die Methode des Mind Uploadings vorgeschlagen. Anstatt Intelligenz direkt zu programmieren, wird hierbei der Aufbau eines menschlichen Gehirns per Scan in den Computer übertragen. Die dazu nötige Auflösung des Scanners, die benötigte Rechenkraft und das erforderliche Wissen über das Gehirn machen dies in der Präsingularitätszeit jedoch eher unwahrscheinlich.

Daneben wurde noch die Emergenz intelligenten Verhaltens aus einem hinreichend komplexen Computernetzwerk, so genannte Schwarmintelligenz, in Betracht gezogen, beispielsweise von George Dyson in dem Buch Darwin Among the Machines.

Auswirkungen

Singularitäten im mathematisch-physikalischen Sinne sind Punkte, ab denen die gewohnten Gesetzmäßigkeiten nicht mehr zutreffen. Ebenso wird die technologische Singularität als Zeitpunkt gehandelt, ab dem das menschliche Verständnis der Welt nicht mehr zutrifft. Heute selbstverständliche Grundprinzipien wie die biologische Evolution könnten außer Kraft treten und die entstandene Superintelligenz könnte ein Verständnis der Wirklichkeit erwerben, das jegliche Vorstellungskraft sprengt; die Auswirkungen können schlicht nicht festgemacht werden, weil sie von einer Intelligenz bestimmt würden, die der menschlichen ständig weiter überlegen sein würde.

Einige sehnen die technologische Singularität herbei. Sie vertreten die Meinung, dies sei genau das Ziel, auf das die Evolution hinauslaufe. Letztlich erhoffen sie die Erschaffung übermenschlicher Wesen, die eine Antwort auf den Sinn des Lebens liefern oder das Universum einfach nur in einen lebenswerteren Ort verwandeln. Eine Gefahr sehen sie in dieser höheren Intelligenz nicht, denn gerade weil sie höher entwickelt sei, verfüge sie über ein dem Menschen überlegenes, friedfertiges ethisches Bewusstsein.

Andere meinen, das Eintreten einer technologischen Singularität müsse verhindert werden. Intelligenz habe mit Friedfertigkeit nichts zu tun und die entstehende Superintelligenz könne die Menschheit mühelos ausrotten. Sie sehen bereits im Streben nach einer technologischen Singularität einen logischen Fehler, denn Sinn und Zweck von Technologie sei es gerade, den Menschen das Leben leichter zu machen; für sich selbst denkende Technologie verstoße gegen diese Definition und sei daher prinzipiell nicht erstrebenswert.

Kritik

Die Theorie der technologischen Singularität wird von vielen verschiedenen Seiten kritisiert. Ein Kritikpunkt sind fehlerhafte Datenauslegung und damit mangelnde Wissenschaftlichkeit. So wird beispielsweise als Beleg für die exponentielle Steigerung der Rechenleistung gerne das Mooresche Gesetz herangezogen – dieses sagt aber zunächst nichts über die Rechenleistung eines Computersystems aus. Weitere Kritik richtet sich gegen die Annahme, der Technologiefortschritt werde sich weiterhin im bekannten Maße beschleunigen. Kritiker merken an, dass die derzeitige Steigerung der Rechenleistung auf eine Verkleinerung der Computerschaltkreise zurückgeht; diese sei jedoch physikalisch begrenzt und das Erreichen dieser Grenze könne mit einem Knick in der Leistungskurve einhergehen. Der technologische Fortschritt hänge zudem von zahlreichen weiteren Faktoren ab. So würden etwa wirtschaftlich nicht rentable Forschungsgebiete erfahrungsgemäß vernachlässigt und explodierende Forschungs- und Entwicklungskosten könnten ganze Technologiezweige schnell aus dem Rennen werfen.

Der wohl wichtigste Kritikpunkt spricht jedoch die stagnierende Forschung im Gebiet starke künstliche Intelligenz an. Trotz jahrzehntelanger Forschung zeichnet sich hier nicht einmal ein kleiner Durchbruch ab. Das wirtschaftliche Interesse am Thema ist bereits in den 1970er Jahren erloschen und hat sich der vielversprechenderen schwachen Intelligenz – hochspezialisierten Problemlösern für Einzelaufgaben – zugewandt. Zwar bilden Perzeptronen (einfache neuronale Netze) den menschlichen Wahrnehmungsprozess mit wenigen Nervenzellen nach, die Simulation eines kompletten Gehirns steht jedoch noch nicht in Aussicht. Die Funktionsweise des menschlichen Gehirns selbst ist noch nicht ausreichend verstanden; ohne dieses Wissen, so die Argumentation, sei jedoch an eine ausgereifte Computer-Gehirn-Schnittstelle nicht zu denken, von technischen Intelligenzerweiterungen oder der genetischen Zucht eines Genies ganz zu schweigen.

Andere Kritik äußert Zweifel am Singularitätsbegriff. So habe es in der Geschichte der Menschheit viele Zeitpunkte gegeben, zu denen die Welt, in der wir heute leben, völlig unvorstellbar gewesen wäre. Begrenze man die Definition der Singularität auf „überschreitet die Grenze unseres Vorstellungsvermögens“, so sei die angesprochene Singularität nichts Einmaliges, sondern ein immer wieder stattfindendes Ereignis.

Schließlich gibt es Kritik an der Originalität der Theorie. Für den Science-Fiction-Schriftsteller Ken MacLeod etwa ist die Idee der technologischen Singularität nichts weiter als die technisierte Neuauflage des theologischen Begriffs der Lehre von den Hoffnungen auf Vollendung der Welt (der sog. Eschatologie).

Organisationen

Das Singularity Institute for Artificial Intelligence (SIAI) ist eine gemeinnützige Bildungs- und Forschungsorganisation, die sich der Erforschung und Umsetzung von freundlicher künstlicher Intelligenz (Friendly AI) gewidmet hat. Gegründet wurde diese Institution von Eliezer Yudkowsky, Brian Atkins und Sabine Atkins.

Die Acceleration Studies Foundation (ASF) will die Aufmerksamkeit von Wirtschaft, Wissenschaft und Technik auf den sich beschleunigenden technologischen Fortschritt lenken. Dazu wird alljährlich die an der Stanford University stattfindende Konferenz Accelerating Change abgehalten. Zudem betreibt die Organisation Acceleration Watch[3] eine futurologische Informationswebseite, die aktuelle Entwicklungen im Licht des zunehmenden technologischen Wandels betrachtet.

Prominente Vertreter

Literatur

- Alvin Toffler: Der Zukunftsschock. Strategien für die Welt von morgen. Goldmann, München 1983, ISBN 3-442-11364-4 (Goldmann. Goldmann-Sachbuch 11364).

- Damien Broderick: The Spike. How Our Lives Are Being Transformed by Rapidly Advancing Technologies. Forge, New York NY 2001, ISBN 0-312-87781-1.

- Raymond Kurzweil: The Singularity Is Near. When Humans Transcend Biology. Viking Books, New York NY u. a. 2005, ISBN 0-670-03384-7.

- Charles Stross: Accelerando. Heyne, München 2006, ISBN 3-453-52195-1.

Weblinks

- Der Mensch, Version 2.0 (PDF) – Artikel von Raymond Kurzweil in Spektrum der Wissenschaft, Januar 2006 (322 kB)

- Interview mit Robin Hanson bei EconTalk, 2. Januar 2011

- Singularity Institute for Artificial Intelligence

- The Law of Accelerating Returns von Ray Kurzweil

- Vernor Vinges Artikel im Original

Einzelnachweise

- ↑ http://berglas.org/Articles/AIKillGrandchildren/AIKillGrandchildren.html Artificial Intelligence Will Kill Our Grandchildren (Singularity), Anthony Berglas, englisch, abgerufen 20. Februar 2011

- ↑ http://www.kurzweilai.net/articles/art0134.html?printable=1, (Stand: 28. Februar 2009)

- ↑ Acceleration Watch (englisch) – Webseite zum Thema Zukunftsforschung

Kategorie:- Techniktheorie

Wikimedia Foundation.