- Variationsproblem

-

Die Variationsrechnung ist eine Sparte der Mathematik, die um die Mitte des 18. Jahrhunderts insbesondere von Leonhard Euler und von Joseph-Louis Lagrange entwickelt wurde.[1] Sie beschäftigt sich mit reellen Funktionen von Funktionen, die auch Funktionale genannt werden. Solche Funktionale können etwa Integrale über eine unbekannte Funktion und ihre Ableitungen sein. Dabei interessiert man sich für stationäre Funktionen, also solche, für die das Funktional ein Maximum, ein Minimum oder einen Sattelpunkt annimmt. Einige klassische Probleme können elegant mit Hilfe von Funktionalen formuliert werden.

Ein Beispiel ist das Brachistochronenproblem: Auf welcher Kurve in einem Schwerefeld von einem Punkt A zu einem Punkt B, der unterhalb, aber nicht direkt unter A liegt, benötigt ein Objekt die geringste Zeit zum Durchlaufen der Kurve? Von allen Kurven zwischen A und B minimiert eine den Ausdruck, der die Zeit des Durchlaufens der Kurve beschreibt. Dieser Ausdruck ist ein Integral, das die unbekannte, gesuchte Funktion, die die Kurve von A nach B beschreibt, und deren Ableitungen enthält.

Das Schlüsseltheorem der Variationsrechnung ist die Euler-Lagrange-Gleichung, genauer „Euler-Lagrange'sche Differentialgleichung“. Diese beschreibt die Stationäritätsbedingung eines Funktionals. Wie bei der Aufgabe, die Maxima und Minima einer Funktion zu bestimmen, wird sie aus der Analyse kleiner Änderungen um die angenommene Lösung hergeleitet.

Die Variationsrechnung ist besonders in der theoretischen Physik wichtig, so etwa im Lagrange-Formalismus der klassischen Mechanik bzw. der Bahnbestimmung, in der Quantenmechanik in Anwendung des Prinzips der kleinsten Wirkung und in der statistischen Physik im Rahmen der Dichtefunktionaltheorie. In der Mathematik wurde die Variationsrechnung beispielsweise bei der riemannschen Behandlung des Dirichlet-Prinzips für harmonische Funktionen verwendet. Auch in der Steuerungs- und Regelungstheorie findet die Variationsrechnung Anwendung, wenn es um die Bestimmung von Optimalreglern geht.

Die Methoden der Variationsrechnung tauchen bei den Hilbertraum-Techniken, der Morse-Theorie und bei der symplektischen Geometrie auf. Der Begriff Variation wird für alle Extremal-Probleme von Funktionen verwendet. Geodäsie und Differentialgeometrie sind Bereiche der Mathematik, in denen Variationen eine Rolle spielen. Besonders am Problem der minimalen Oberflächen, die etwa bei Seifenblasen auftreten, wurde viel gearbeitet.

Inhaltsverzeichnis

Ein Hilfsmittel aus der Analysis reeller Funktionen in einer reellen Veränderlichen

Im Folgenden wird eine wichtige Technik der Variationsrechnung demonstriert, bei der eine notwendige Aussage für eine lokale Minimumstelle einer reellen Funktion mit nur einer reellen Veränderlichen in eine notwendige Aussage für eine lokale Minimumstelle eines Funktionals übertragen wird. Diese Aussage kann dann oftmals zum Aufstellen beschreibender Gleichungen für stationäre Funktionen eines Funktionals benutzt werden.

Sei ein Funktional

auf einem Funktionenraum X gegeben (X muss mind. ein topologischer Raum sein). Das Funktional habe an der Stelle

auf einem Funktionenraum X gegeben (X muss mind. ein topologischer Raum sein). Das Funktional habe an der Stelle  ein lokales Minimum.

ein lokales Minimum.Durch den folgenden einfachen Trick tritt an die Stelle des „schwierig handhabbaren“ Funktionals I eine reelle Funktion F(α), die nur von einem reellen Parameter α abhängt „und entsprechend einfacher zu behandeln ist“.

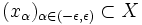

Mit einem ε > 0 sei

eine beliebige stetig durch den reellen Parameter α parametrisierte Familie von Funktionen

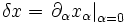

eine beliebige stetig durch den reellen Parameter α parametrisierte Familie von Funktionen  . Dabei sei die Funktion x0 (d. h., xα für α = 0) gerade gleich der stationären Funktion x. Außerdem sei die durch die Gleichung

. Dabei sei die Funktion x0 (d. h., xα für α = 0) gerade gleich der stationären Funktion x. Außerdem sei die durch die GleichungF(α): = I(xα)

definierte Funktion

an der Stelle α = 0 differenzierbar.

an der Stelle α = 0 differenzierbar.Die stetige Funktion F nimmt dann an der Stelle α = 0 ein lokales Minimum an, da x0 = x ein lokales Minimum von I ist.

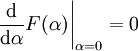

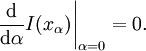

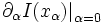

Aus der Analysis für reelle Funktionen in einer reellen Veränderlichen ist bekannt, dass dann

gilt. Auf das Funktional übertragen heißt das

gilt. Auf das Funktional übertragen heißt das

Beim Aufstellen der gewünschten Gleichungen für stationäre Funktionen wird dann noch ausgenutzt, dass die vorstehende Gleichung für jede beliebige („gutartige“) Familie

mit x0 = x gelten muss.

mit x0 = x gelten muss.Das soll im nächsten Abschnitt anhand der Euler-Gleichung demonstriert werden.

Euler-Lagrange-Gleichung; Variationsableitung

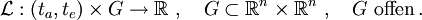

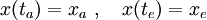

Gegeben seien zwei Zeitpunkte

mit te > ta und eine in allen Argumenten zweifach stetig differenzierbare Funktion, die Lagrangefunktion

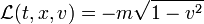

mit te > ta und eine in allen Argumenten zweifach stetig differenzierbare Funktion, die LagrangefunktionBeispielsweise ist bei der Lagrangefunktion des relativistischen Teilchens mit Masse m

das Gebiet G das kartesische Produkt von

und dem Inneren der Einheitskugel.

und dem Inneren der Einheitskugel.Als Funktionenraum X wird die Menge aller zweifach stetig differenzierbaren Funktionen

gewählt, die zum Anfangszeitpunkt ta und zum Endzeitpunkt te die fest vorgegebenen Orte xa bzw. xe einnehmen:

und deren Werte zusammen mit den Werten ihrer Ableitung in G liegen,

![\forall t\in [t_a,t_e]:\ (x(t),\frac{\mathrm{d}x}{\mathrm{d}t}(t)) \in G](/pictures/dewiki/52/4a334d5270e9f62cdfd804fbc01d89e7.png) .

.

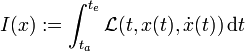

Mit der Lagrangefunktion

wird nun das Funktional

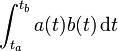

wird nun das Funktional  , die Wirkung, durch

, die Wirkung, durchdefiniert. Gesucht ist diejenige Funktion

, die die Wirkung I minimiert.

, die die Wirkung I minimiert.Entsprechend der im vorhergehenden Abschnitt vorgestellten Technik untersuchen wir dazu alle differenzierbaren einparametrigen Familien

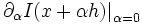

, die für α = 0 durch die stationäre Funktion x des Funktionals gehen (es gilt also x0 = x). Genutzt wird die im letzten Abschnitt hergeleitete Gleichung

, die für α = 0 durch die stationäre Funktion x des Funktionals gehen (es gilt also x0 = x). Genutzt wird die im letzten Abschnitt hergeleitete GleichungHereinziehen der Differentiation nach dem Parameter α in das Integral liefert mit der Kettenregel

Dabei stehen

für die Ableitungen nach dem zweiten bzw. dritten Argument und

für die Ableitungen nach dem zweiten bzw. dritten Argument und  für die partielle Ableitung nach dem Parameter α.

für die partielle Ableitung nach dem Parameter α.Es wird sich später als günstig erweisen, wenn im zweiten Integral statt

wie im ersten Integral

wie im ersten Integral  steht. Das erreicht man durch partielle Integration:

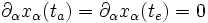

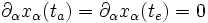

steht. Das erreicht man durch partielle Integration:An den Stellen t = ta und t = te gelten unabhängig von α die Bedingungen xα(ta) = xa und xα(te) = xe. Ableiten dieser beiden Konstanten nach α liefert

. Deshalb verschwindet der Term

. Deshalb verschwindet der Term ![\left[\partial_3 \mathcal{L}(t,x_\alpha(t),\dot x_\alpha(t))\partial_\alpha x_\alpha(t)\right]_{t=t_a}^{t_e}](/pictures/dewiki/49/1c9901313be93a7c4dc64a25ace66584.png) und man erhält nach Zusammenfassen der Integrale und Ausklammern von

und man erhält nach Zusammenfassen der Integrale und Ausklammern von  die Gleichung

die Gleichungund mit xα(t) | α = 0 = x(t)

Außer zum Anfangszeitpunkt und zum Endzeitpunkt unterliegt xα(t) keinen Einschränkungen. Damit sind die Zeitfunktionen

![t\mapsto\left[\partial_\alpha x_\alpha(t)\right]_{\alpha=0}](/pictures/dewiki/102/ffaaa362f20e1f0978680272bbc0aa29.png) bis auf die Bedingungen

bis auf die Bedingungen  beliebige zweimal stetig differenzierbare Zeitfunktionen. Die letzte Gleichung kann also nur dann für alle zulässigen

beliebige zweimal stetig differenzierbare Zeitfunktionen. Die letzte Gleichung kann also nur dann für alle zulässigen ![\left[\partial_\alpha x_\alpha\right]_{\alpha=0}](/pictures/dewiki/52/475a1f855b77f686df1bf0eba3303604.png) erfüllt sein, wenn der Faktor

erfüllt sein, wenn der Faktor  im gesamten Integrationsintervall gleich null ist (das wird in den Bemerkungen etwas detaillierter erläutert). Damit erhält man für die stationäre Funktion x die Euler-Lagrange-Gleichung

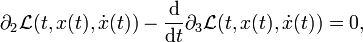

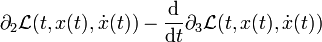

im gesamten Integrationsintervall gleich null ist (das wird in den Bemerkungen etwas detaillierter erläutert). Damit erhält man für die stationäre Funktion x die Euler-Lagrange-Gleichungdie für alle

erfüllt sein muss.

erfüllt sein muss.Die angegebene, zum Verschwinden zu bringende Größe bezeichnet man auch als Eulerableitung der Lagrangefunktion

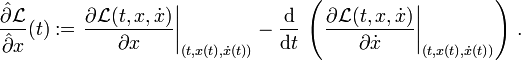

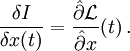

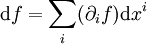

Vor allem in Physikbüchern wird die Ableitung

als Variation bezeichnet. Dann ist

als Variation bezeichnet. Dann ist  die Variation von

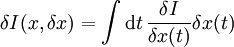

die Variation von  Die Variation der Wirkung

Die Variation der Wirkungist wie bei

eine Linearform in den Variationen der Argumente, ihre Koeffizienten

eine Linearform in den Variationen der Argumente, ihre Koeffizienten  heißen Variationsableitung des Funktionals

heißen Variationsableitung des Funktionals  Sie ist im betrachteten Fall die Eulerableitung der Lagrangefunktion

Sie ist im betrachteten Fall die Eulerableitung der LagrangefunktionBemerkungen

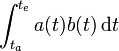

Bei der Herleitung der Euler-Lagrange-Gleichung wurde benutzt, dass eine stetige Funktion a, die für alle mind. zweimal stetig differenzierbaren Funktionen b mit b(ta) = b(te) = 0 bei Integration über

den Wert Null ergibt, identisch gleich null sein muss.

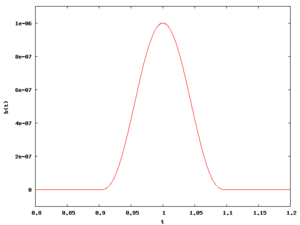

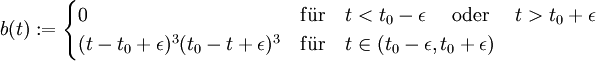

Das ist leicht einzusehen, wenn man berücksichtigt, dass es zum Beispiel mit

eine zweimal stetig differenzierbare Funktion gibt, die in einer ε-Umgebung eines willkürlich herausgegriffenen Zeitpunktes

positiv und ansonsten null ist. Gäbe es eine Stelle t0, an der die Funktion a größer oder kleiner null wäre, so wäre sie aufgrund der Stetigkeit auch noch in einer ganzen Umgebung (t0 − ε,t0 + ε) dieser Stelle größer bzw. kleiner null. Mit der eben definierten Funktion b ist dann jedoch das Integral

positiv und ansonsten null ist. Gäbe es eine Stelle t0, an der die Funktion a größer oder kleiner null wäre, so wäre sie aufgrund der Stetigkeit auch noch in einer ganzen Umgebung (t0 − ε,t0 + ε) dieser Stelle größer bzw. kleiner null. Mit der eben definierten Funktion b ist dann jedoch das Integral  im Widerspruch zur Voraussetzung an a ebenfalls größer bzw. kleiner null. Die Annahme, dass a an einer Stelle t0 ungleich null wäre, ist also falsch. Die Funktion a ist also wirklich identisch gleich null.

im Widerspruch zur Voraussetzung an a ebenfalls größer bzw. kleiner null. Die Annahme, dass a an einer Stelle t0 ungleich null wäre, ist also falsch. Die Funktion a ist also wirklich identisch gleich null.Ist der Funktionenraum X ein affiner Raum, so wird die Familie

in der Literatur oftmals als Summe xα(t): = x(t) + αh(t) mit einer frei wählbaren Zeitfunktion h festgelegt, die der Bedingung h(ta) = h(te) = 0 genügen muss. Die Ableitung

in der Literatur oftmals als Summe xα(t): = x(t) + αh(t) mit einer frei wählbaren Zeitfunktion h festgelegt, die der Bedingung h(ta) = h(te) = 0 genügen muss. Die Ableitung  ist dann gerade die Gateaux-Ableitung

ist dann gerade die Gateaux-Ableitung  des Funktionals I an der Stelle x in Richtung h. Die hier vorgestellte Version erscheint dem Autor etwas günstiger, wenn die Funktionenmenge X kein affiner Raum mehr ist (wenn sie beispielsweise durch eine nichtlineare Nebenbedingung eingeschränkt ist; siehe etwa gaußsches Prinzip des kleinsten Zwanges). Sie ist ausführlicher in [1] dargestellt und lehnt sich an die Definition von Tangentialvektoren an Mannigfaltigkeiten an (siehe auch [2]).

des Funktionals I an der Stelle x in Richtung h. Die hier vorgestellte Version erscheint dem Autor etwas günstiger, wenn die Funktionenmenge X kein affiner Raum mehr ist (wenn sie beispielsweise durch eine nichtlineare Nebenbedingung eingeschränkt ist; siehe etwa gaußsches Prinzip des kleinsten Zwanges). Sie ist ausführlicher in [1] dargestellt und lehnt sich an die Definition von Tangentialvektoren an Mannigfaltigkeiten an (siehe auch [2]).Siehe auch

Einzelnachweise

Literatur

- Oskar Bolza: Vorlesungen Uber Variationsrechnung B. G. Teubner, Leipzig, 1909.

- [2] H. Fischer, H. Kaul: Mathematik für Physiker, Band 3. 2. Auflage. Teubner Verlag, Wiesbaden 2006. ISBN 3-8351-0031-9

- Adolf Kneser: Variationsrechnung in: Encyklopädie der mathematischen Wissenschaften mit Einschluss ihrer Anwendungen Zweiter Band, Erster Teil, p. 571 B. G. Teubner, Leipzig, 1898.

- [1] W. I. Smirnow: Lehrgang der höheren Mathematik, Teil (IV/1). 17. Auflage. VEB Deutscher Verlag der Wissenschaften, Berlin 1990.

- Paul Staeckel: Abhandlungen über variations-rechnung W. Engelmann, Leipzig, 1894.

Wikimedia Foundation.

![x:[t_a,t_e]\rightarrow\mathbb{R}^n](/pictures/dewiki/100/de99c64e941f66f4d904e74e6a646f67.png)

![0=\left.\frac{d}{d\alpha} I(x_\alpha)\right|_{\alpha=0}

=\left[\frac{\mathrm{d}}{\mathrm{d}\alpha} \int_{t_a}^{t_e} \mathcal{L}(t,x_\alpha(t),\dot x_\alpha(t))\,\mathrm{d}t\right]_{\alpha=0}](/pictures/dewiki/99/c9129b6b760ecb83b665515a3a68e589.png)

![0=\left[\int_{t_a}^{t_e}\left(\partial_2 \mathcal{L}(t,x_\alpha(t),\dot x_\alpha(t))\partial_\alpha x_\alpha(t)

+

\partial_3 \mathcal{L}(t,x_\alpha(t),\dot x_\alpha(t))\partial_\alpha\dot x_\alpha(t)

\right)\,\mathrm{d}t\right]_{\alpha=0}](/pictures/dewiki/97/aec2b227236fc7aa119610b1fed5b3d7.png)

![\ =\left[\int_{t_a}^{t_e}\partial_2 \mathcal{L}(t,x_\alpha(t),\dot x_\alpha(t))\partial_\alpha x_\alpha(t)\,\mathrm{d}t

+

\int_{t_a}^{t_e}\partial_3 \mathcal{L}(t,x_\alpha(t),\dot x_\alpha(t))\partial_\alpha\dot x_\alpha(t)

\,\mathrm{d}t\right]_{\alpha=0}.](/pictures/dewiki/54/64482a62a59b589063d26d8beaffb783.png)

![0=\left[\int_{t_a}^{t_e}\partial_2 \mathcal{L}(t,x_\alpha(t),\dot x_\alpha(t))\,\partial_\alpha x_\alpha(t)\,\mathrm{d}t

+

\left[\partial_3 \mathcal{L}(t,x_\alpha(t),\dot x_\alpha(t))\,\partial_\alpha x_\alpha(t)\right]_{t=t_a}^{t_e}\right .](/pictures/dewiki/101/e9fe18a4c4eb045e4b9ed8ffa46d394a.png)

![-

\left .\int_{t_a}^{t_e}\frac{\mathrm{d}}{\mathrm{d}t} \left(\partial_3 \mathcal{L}(t,x_\alpha(t),\dot x_\alpha(t))\right)\,\partial_\alpha x_\alpha(t)

\,\mathrm{d}t\right]_{\alpha=0}](/pictures/dewiki/54/698f65283efbef959b10a9a9da9c2f7b.png)

![0=\left[\int_{t_a}^{t_e}\left(\partial_2 \mathcal{L}(t,x_\alpha(t),\dot x_\alpha(t))

-

\frac{\mathrm{d}}{\mathrm{d}t}\partial_3 \mathcal{L}(t,x_\alpha(t),\dot x_\alpha(t))\right)\,\partial_\alpha x_\alpha(t)

\,\mathrm{d}t\right]_{\alpha=0}.](/pictures/dewiki/53/5af8606dd3f16b052b77d0b62b489943.png)

![0=\int_{t_a}^{t_e}\left(\partial_2 \mathcal{L}(t,x(t),\dot x(t))

-

\frac{\mathrm{d}}{\mathrm{d}t}\partial_3 \mathcal{L}(t,x(t),\dot x(t))\right)\left[\partial_\alpha x_\alpha(t)\right]_{\alpha=0}

\,\mathrm{d}t.](/pictures/dewiki/102/fcdc28bf4e28ed4dd1f326b50984fc38.png)