- Prozessor (Hardware)

-

Ein Prozessor ist eine Maschine oder eine elektronische Schaltung (i.A. ein IC), welche gemäß übergebener Befehle andere Maschinen oder elektrische Schaltungen steuert und dabei einen Prozess oder Algorithmus vorantreibt, was meist Datenverarbeitung beinhaltet. Am populärsten sind Prozessoren als zentrale Recheneinheiten von Computern, in denen sie Befehle (Software) ausführen.

Hauptbestandteile des Prozessors sind die Register, das Rechenwerk (Arithmetisch-logische Einheit, ALU), das Steuerwerk und der Speichermanager (Memory Management Unit, MMU), der den Arbeitsspeicher verwaltet. Zu den zentralen Aufgaben des Prozessors gehören arithmetische und logische Operationen, das Lesen und Schreiben von Daten im Arbeitsspeicher, das Ausführen von Sprüngen im Programm sowie die Steuerung und Verwaltung der Peripheriegeräte.

Prozessoren werden heute meist im Bereich der Eingebetteten Systeme (engl. Embedded Systems) eingesetzt. PCs enthalten meist mehrere Prozessoren, wobei der Hauptprozessor (Zentralprozessor) alle weiteren steuert. Im allgemeinen Sprachgebrauch ist mit „Prozessor“ meist der Zentralprozessor (CPU = Central Processing Unit) eines Computers gemeint, also das funktionale Kernstück eines elektronischen Rechners, das heute normalerweise auf einem Mikrochip integriert ist. Die moderne Form des Prozessors ist der Mikroprozessor, der alle Bausteine des Prozessors auf einem Chip vereinigt. Moderne PC-Prozessoren sind Multikernprozessoren mit zwei, vier oder noch mehr Kernen (etwa der Intel Core 2 oder der AMD Athlon X2). Weiterhin werden in Großrechnern (engl. mainframes) meist proprietäre Prozessoren des jeweiligen Herstellers verwendet, wie etwa bei IBM (Cell-Prozessor) oder SUN (SPARC-Prozessor). Prozessoren für Eingebettete Systeme machen etwa 95 % des Prozessormarkts aus, wobei davon 90 % sogenannte Mikrocontroller sind, die neben dem eigentlichen Prozessor weitere Funktionen (z. B. ROM, RAM) enthalten. Nur etwa 5 % werden in PCs, Workstations oder Servern eingesetzt.[1]

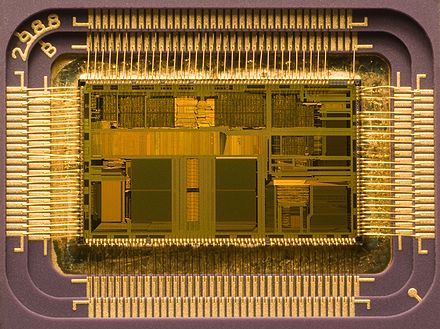

Der „Die“ eines Intel 80486DX2

Der „Die“ eines Intel 80486DX2

Inhaltsverzeichnis

Historische Entwicklung

In den 1930er Jahren bestand das Rechenwerk eines Computers zunächst aus Relais und mechanischen Bauelementen. Die ersten Computer waren also elektromechanische Rechner, die langsam und äußerst störanfällig waren. Noch in den 1940ern begann man damit, Computer mit Hilfe von Röhren zu bauen. Die Rechner wurden schneller und weniger störanfällig. Waren diese Rechner anfangs teure Einzelprojekte, so reifte die Technik im Laufe der 1950er Jahre immer mehr aus. Röhrencomputer wurden nach und nach zu Artikeln der Serienfertigung, die für Universitäten, Forschungseinrichtungen und Firmen durchaus erschwinglich waren. Um dieses Ziel zu erreichen, war es notwendig, die Anzahl der benötigten Röhren auf ein Mindestmaß zu reduzieren. Aus diesem Grund setzte man Röhren nur dort ein, wo sie unabdingbar waren. So begann man damit, Hauptspeicher und CPU-Register auf einer Magnettrommel unterzubringen, Rechenoperationen seriell auszuführen und die Ablaufsteuerung mit Hilfe einer Diodenmatrix zu realisieren. Ein typischer Vertreter dieser Rechnergeneration war der LGP-30.

In den frühen 1960ern wurden die Röhren dann von den Transistoren verdrängt. Anfangs wurden die CPUs aus einzelnen Transistoren aufgebaut. Im Laufe der Jahre brachte man aber immer mehr Transistorfunktionen auf integrierten Schaltkreisen (ICs) unter. Waren es zunächst nur einzelne Gatter, integrierte man immer häufiger auch ganze Register und Funktionseinheiten wie Addierer und Zähler, schließlich dann sogar Registerbänke und Rechenwerke auf einem Chip. Diese zunehmende Integration von immer mehr Transistor- und Gatterfunktionen auf einem Chip führte dann fast zwangsläufig zu dem, was heute als Mikroprozessor bekannt ist.

Aufbau

Ein Prozessor besteht aus Registern, einem Rechenwerk (der Arithmetic Logical Unit, kurz ALU), einem Befehlsdecoder, einem Steuerwerk sowie den Datenleitungen (Busse), die die Kommunikation mit anderen Komponenten ermöglichen.

Register

Register sind prozessorinterne Speicher, die sehr nahe und schnelle Verbindungen zu anderen Prozessorkomponenten bereitstellen. Nur mit den Daten in den Registern können direkt Operationen ausgeführt werden. Sie stellen daher die erste Stufe der Speicherhierarchie dar.

- Arbeitsregister können Daten (als Datenregister) und, abhängig vom Prozessortyp, auch Adressen (als Adressregister) aufnehmen.

- Das Befehlszählregister nimmt immer die Adresse des Befehls auf, der als Nächstes ausgeführt werden soll. Es wird daher auch häufig Instruction Pointer (IP) genannt.

- Das Befehlsregister nimmt binäre Maschinenbefehle auf.

Von den Eigenschaften und insbesondere der Größe der Register (abhängig vom Prozessortyp) hängt u. a. die Leistungsfähigkeit des jeweiligen Prozessors ab.

Rechenwerk

Das Rechenwerk (Arithmetisch-logische Einheit, ALU) führt die Elementaroperationen eines Rechners durch. Es kann sowohl arithmetische (etwa die Addition zweier Zahlen) als auch logische (etwa AND oder OR) Operationen ausführen.

Befehlsdecoder

Der Befehlsdecoder übersetzt binäre Maschinenbefehle mit Hilfe der Befehlstabelle (engl. Instruction Table) in entsprechende Anweisungen, welche die für die Ausführung des Befehls benötigten Schaltungen aktivieren.

Steuerwerk

Das Steuerwerk kontrolliert die Ausführung der Anweisungen. Es sorgt dafür, dass der Maschinenbefehl im Befehlsregister vom Befehlsdecoder decodiert und vom Rechenwerk ausgeführt wird, lädt den an der im Befehlszählerregister hinterlegten Adresse befindlichen Befehl ins Befehlsregister sowie die nächste Adresse ins Befehlszählerregister.

Datenleitungen

Über verschiedene Busse (Signalleitungen) ist der Prozessor mit anderen Komponenten verbunden.

- Über den Datenbus werden Daten mit dem Arbeitsspeicher ausgetauscht, etwa die Informationen für die Arbeitsregister und das Befehlsregister. Je nach verwendeter Prozessorarchitektur hat ein Hauptprozessor (eine CPU) einen einzigen Bus für Daten aus dem Arbeitsspeicher (Von-Neumann-Architektur) oder mehrere (meist zwei) separate Datenleitungen für den Programmcode und normale Daten (Harvard-Architektur).

- Der Adressbus dient zur Übertragung von Speicheradressen. Dabei wird jeweils eine Speicherzelle des RAM adressiert (ausgewählt) in die – je nach Signal des Steuerbusses – die Daten, die gerade auf dem Datenbus liegen, geschrieben oder aus denen die Daten gelesen, d. h. auf den Datenbus gelegt, werden.

- Mit dem Steuerbus (Kontrollbus) steuert der Prozessor u. a. die Peripherie-Anschlüsse (z. B. USB, PCI) an.

Caches

Moderne Prozessoren, die in PCs oder anderen Geräten, die eine schnelle Datenverarbeitung benötigen, eingesetzt werden, sind mit sogenannten Caches ausgestattet. Caches sind Zwischenspeicher, die die letzten verarbeiteten Daten und Befehle enthalten und so die rasche Wiederverwendung ermöglichen. Sie stellen die zweite Stufe der Speicherhierarchie dar. Normalerweise besitzt ein Prozessor heutzutage bis zu drei verschiedene Caches:

- Level-1-Cache (L1-Cache): Dieser Cache läuft mit dem Prozessortakt. Er ist sehr klein (etwa 4 bis 256 Kilobyte), dafür aufgrund seiner Position im Prozessorkern selbst sehr schnell abrufbar.

- Level-2-Cache (L2-Cache): Der L2-Cache befindet sich meist im Prozessor, aber nicht im Kern selbst. Er umfasst zwischen 64 Kilobyte und 12 Megabyte.

- Level-3-Cache (L3-Cache): Bei Mehrkernprozessoren teilen sich die einzelnen Kerne den L3-Cache. Er ist der langsamste der drei Caches, aber auch der größte (bis zu 256 Megabyte).

Weitere

Zur Erhöhung der Rechengeschwindigkeit können Prozessoren mit besonderen (etwa einem Hardwaremultiplizierer) bzw. zusätzlichen (etwa einem Gleitkommarechenwerk) Rechenwerken ausgestattet sein. Zur effizienteren Bearbeitung von Befehlen werden Pipelines verwendet. Ein Prozessor besteht aus Registern, einem Rechenwerk (der Arithmetic Logical Unit, kurz ALU), einem Befehlsdecoder, einem Steuerwerk sowie den Datenleitungen (Busse), die die Kommunikation mit anderen Komponenten ermöglichen.

Funktionsweise

Die Befehlsbearbeitung moderner Prozessoren folgt dem Von-Neumann-Zyklus.

- Aus dem Befehlszählregister wird die Adresse des nächsten Maschinenbefehls gelesen. Dieser wird aus dem Arbeitsspeicher in das Befehlsregister geladen. (FETCH)

- Der Befehlsdecoder decodiert den Befehl und aktiviert entsprechende Schaltungen, die für die Ausführung des Befehls nötig sind. (DECODE)

- Von der Festplatte, einem Wechseldatenträger, dem Arbeitsspeicher oder einem Cache-Speicher werden Daten in die Arbeitsregister geladen, die zur Ausführung nötig sind (etwa zu verändernde Werte oder benötigte Parameter). (FETCH OPERANDS)

- Der Befehl wird ausgeführt. Dies kann die Ansteuerung von Peripheriegeräten, die Ausführung von Operationen im Rechenwerk oder ein Sprung im Programm (eine Veränderung des Befehlszählerregisters) sein. (EXECUTE)

- Sollte kein Sprungbefehl in der EXECUTE-Phase erfolgt sein, wird nun der Befehlszähler um 1 erhöht (UPDATE INSTRUCTION POINTER)

Gelegentlich unterscheidet man auch noch eine Rückschreibphase, in der eventuell anfallende Rechenergebnisse in bestimmte Register geschrieben werden. Erwähnt werden sollten noch sogenannte Hardware-Interrupts. Die Hardware eines Computers kann Anfragen an den Prozessor stellen. Da diese Anfragen asynchron auftreten, ist der Prozessor gezwungen, regelmäßig zu prüfen, ob solche vorliegen und diese eventuell vor der Fortsetzung des eigentlichen Programms bearbeiten.

Steuerung

Alle Programme liegen letztlich als eine Folge von binären Maschinenbefehlen im Speicher. Nur diese Befehle können vom Prozessor verarbeitet werden. Dieser Code ist für einen Menschen jedoch beinahe unmöglich zu lesen. Aus diesem Grund werden Programme zunächst in Assemblersprache oder einer Hochsprache (etwa BASIC, C, C++, Java) geschrieben und dann von einem Compiler in eine ausführbare Datei, also in Maschinensprache übersetzt oder einem Interpreter zur Laufzeit ausgeführt.

Symbolische Maschinenbefehle

Um es zu ermöglichen, Programme in akzeptabler Zeit und verständlich zu schreiben, wurde eine symbolische Schreibweise für Maschinenbefehle eingeführt, die Assemblersprache. Einem Maschinenbefehl wird dabei genau ein Schlüsselwort in der Assemblersprache zugeordnet. Damit ist auch der Rückschluss von den Maschinenbefehlen auf das Assemblerprogramm möglich (Disassemblierung). Da jeder Prozessortyp eigene Maschinenbefehle besitzt, existiert für ihn auch eine eigene Assemblersprache. Prozessorunabhängige Programmierung ist erst mit der Benutzung einer Hochsprache möglich, der entsprechende Compiler ist jedoch wieder prozessorspezifisch. Befehle, die für jeden Prozessor gebraucht werden, sind normalerweise identisch. Die Reihenfolge der Ausführung der Assemblerbefehle ist vom Prozessortyp abhängig, in den nachfolgenden Beispielen erfolgt sie von rechts nach links:

- MOV BX, $85F3 Der Wert, der an der Adresse 85F3 (hexadezimale Schreibweise) im Arbeitsspeicher liegt, wird in das Arbeitsregister BX geladen.

- ADD BX, 15 Der Wert 15 wird zum Inhalt des Arbeitsregisters BX addiert.

Binäre Maschinenbefehle

Maschinenbefehle sind sehr prozessorspezifisch und bestehen aus mehreren Teilen. Diese umfassen zumindest den eigentlichen Befehl, den Operationscode (OP-CODE), die Adressierungsart, und den Operandenwert oder eine Adresse. Sie können grob in folgende Kategorien eingeteilt werden:

- Arithmetische Befehle

- Logische Befehle

- Sprungbefehle

- Transportbefehle

- Prozessorkontrollbefehle

Befehlssatz

Der Befehlssatz bezeichnet die Menge der Maschinenbefehle eines Prozessors. Der Umfang des Befehlssatzes variiert je nach Prozessortyp beträchtlich. Nach der Größe des Befehlssatzes kann man zwischen CISC (engl. Complex Instruction Set Computing - Rechnen mit komplexem Befehlssatz)- und RISC (engl. Reduced Instruction Set Computing - Rechnen mit reduziertem Befehlssatz)-Prozessorarchitekturen unterscheiden:

- Die traditionelle CISC-Architektur versucht, immer mehr und immer komplexere Funktionen direkt durch Maschinenbefehle auszudrücken. Sie zeichnet sich besonders durch die große Anzahl zur Verfügung stehender Maschinenbefehle aus, die meist 100 überschreitet. Diese sind außerdem in der Lage, vielschrittige Operationen direkt auszuführen (etwa Gleitpunkt-Operationen). Dadurch sind die erforderlichen Übersetzungsprogramme (Assembler, Compiler und Interpreter) kleiner und einfacher zu programmieren.

- Die neuere RISC-Architektur versucht, möglichst wenige (weniger als 100), dafür jedoch sehr schnelle und einfache Befehle zur Verfügung zu stellen. Dies ermöglicht eine wesentlich schnellere Ausführungsgeschwindigkeit, da weniger Taktzyklen benötigt werden und die Dekodierung aufgrund geringerer Komplexität schneller ist. Auch das Design von Prozessoren mit RISC-Architektur ist einfacher.

Zusätzlich unterscheidet man auch noch zwischen der Adressanzahl im Maschinenbefehl:

- 0-Adressbefehle (Stackrechner)

- 1-Adressbefehle (Akkumulatorrechner)

- 2-Adressbefehle (typischerweise CISC-Rechner)

- 3-Adressbefehle (typischerweise RISC-Rechner)

Prozessor-Kern

Als Prozessorkern (engl. „core“) bezeichnet man das eigentliche Rechen- und Steuerwerk des Prozessors, um das herum weitere Komponenten wie Cache und Memory Management Unit (MMU) angeordnet sind.

Ein Prozessor kann aus mehreren Kernen bestehen und wird dann als Mehrkernprozessor (Multi-Core-Prozessor) bezeichnet. Im Sprachgebrauch sind die Begriffe Single-Core-Prozessor (Einzelkernprozessor), Dual-Core-, Triple-Core-, Quad-Core- und (mit sechs Kernen) Hexa-Core-Prozessor gebräuchlich.

Prozessoren mit mehreren Kernen können sehr unterschiedlich realisiert werden, normalerweise besitzt jeder Kern einen eigenen L1- und L2-Cache. Den großen L3-Cache müssen sich meist alle Kerne teilen.

Der Grund für die Einführung solcher Mehrkernprozessoren liegt in den physikalisch begrenzten Möglichkeiten, einen einzelnen Kern immer schneller zu machen. Die fortschreitende Miniaturisierung von Halbleiterschaltelementen ermöglicht allerdings, dass mehr als ein Kern auf einen Mikrochip passen. Mittlerweile können Strukturen mit einer Kantenlänge unter 32 Nanometer gefertigt werden, womit (Stand 2008) bis zu 1,9 Milliarden Transistoren in einem Prozessor verbaut werden können.[2] (z. B. Intel i7, Codename "Gulftown"). Durch die EUV-Lithografie sollen noch kleinere Strukturen möglich sein. Es ist jedoch damit zu rechnen, dass die Miniaturisierung der konventionellen Prozessortechnik in absehbarer Zeit unüberwindbare Grenzen erreicht. Langfristig könnten sogenannte Quantencomputer die klassische Transistortechnik ablösen.

Die klassische Einteilung, dass ein Steuerwerk und eine ALU als ein Kern bezeichnet werden, verschwimmt zunehmend. Heutige Prozessoren besitzen oft Steuerwerke, die jeweils mehrere Hardware-Threads verwalten (Multi-/Hyper-Threading); das Betriebssystem "sieht" mehr Kerne, als tatsächlich (vollwertige) Steuerwerke vorhanden sind. Außerdem betreibt ein Steuerwerk oft mehrere ALUs sowie noch weitere Baugruppen wie z. B. Gleitkomma-Recheneinheit, Vektoreinheit (siehe auch AltiVec, SSE) oder eine Kryptographie-Einheit. Umgekehrt müssen sich manchmal mehrere Steuerwerke diese Spezial-Recheneinheiten teilen, was eine eindeutige Zuordnung verhindert.

Leistungsmerkmale

Die Leistung eines Prozessors wird maßgeblich durch die Anzahl der Transistoren sowie durch die Wortbreite und den Prozessortakt bestimmt.

Wortbreite

Die Wortbreite legt fest, wie lang ein Maschinenwort des Prozessors sein kann, d. h. aus wie vielen Bits es maximal bestehen kann. Ausschlaggebend sind dabei folgende Werte:

- Arbeits- oder Datenregister: Die Wortbreite bestimmt die maximale Größe der verarbeitbaren Ganz- und Gleitkommazahlen.

- Datenbus: Die Wortbreite legt fest, wie viele Bits gleichzeitig aus dem Arbeitsspeicher gelesen werden können.

- Adressbus: Die Wortbreite legt die maximale Größe einer Speicheradresse, d. h. die maximale Größe des Arbeitsspeichers, fest.

- Steuerbus: Die Wortbreite legt die Art der Peripherieanschlüsse fest.

Die Wortbreite dieser Einheiten stimmt im Normalfall überein, bei aktuellen PCs beträgt sie 32 bzw. 64 Bit.

Prozessortakt

Das Taktsignal (engl. clock rate) wird besonders in der Werbung oft als Beurteilungskriterium für einen Prozessor präsentiert. Sie wird allerdings nicht vom Prozessor selbst bestimmt, sondern ist ein Vielfaches des Mainboard-Grundtaktes. Dieser Multiplikator lässt sich bei einigen Mainboards manuell oder im BIOS einstellen, was als Über- oder Untertakten bezeichnet wird. Das Übertakten kann zu irreparablen Schäden an der Hardware führen.

CPU-Ausführungszeit = CPU-Taktzyklen × Taktzykluszeit

Weiterhin gilt:

Taktzykluszeit = 1 / Taktrate = Programmbefehle × CPI × Taktzykluszeit

Die Geschwindigkeit des gesamten Systems ist jedoch auch von der Größe der Caches, des Arbeitsspeichers und anderen Faktoren abhängig.

Einige Prozessoren haben die Möglichkeit die Taktrate zu erhöhen, wenn es nötig ist, z. B. wenn man sich hochauflösende Videos anschaut oder Spiele spielt, die hohe Anforderungen an das System stellen.

Prozessorarten

Unterscheidung nach Funktion:

- Ein Digitaler Signalprozessor (DSP) ist ein Prozessor, der analoge Signale mit Hilfe digitaler Systeme verarbeitet. DSPs sind nach der Harvard-Architektur aufgebaut, haben also getrennte Bussysteme für Daten und Befehle. Da die Multiplikation eine zentrale Operation der digitalen Signalverarbeitung ist, wird sie meist mit Hilfe eines Barrel-Shifters, einer in der Digitaltechnik gebräuchlichen Schiebelogikschaltung, ausgeführt.

- Spezialisierte Ein-/Ausgabeprozessoren (I/O) sind Prozessoren die Ein- und Ausgabegeräte steuern.

- Der Grafikprozessor (GPU, engl. „Graphics Processing Unit“, neuerdings auch zunehmend VPU für „Visual -“ oder auch „Video Processing Unit“) dient zur Berechnung von Grafikdaten für die Bildschirmausgabe.

- Der Hauptprozessor (CPU, engl. „Central Processing Unit“), im allgemeinen Sprachgebrauch oft auch nur als „Prozessor“ bezeichnet, ist der zentrale (Haupt-)Prozessor eines Computers, der alle anderen Bestandteile steuert.

- Ein mathematischer Koprozessor (FPU, engl. „Floating Point Unit“) ist ein spezieller Prozessor, der der Verarbeitung von Gleitkommazahlen dient. Einst als separater Prozessor realisiert ist der mathematische Koprozessor in modernen Hauptprozessoren in Form einer speziellen Recheneinheit integriert.

- Der Notebookprozessor oder auch Mobilprozessor ist eine Unterart von Hauptprozessoren, die vor allem in mobilen und auch in besonders stromsparenden Computersystemen verwendet wird.

- Ein Physikbeschleuniger (PPU, engl. für „Physics Processing Unit“) ist ein Prozessor, der auf die Verarbeitung und Berechnung von physikalischen Effekten spezialisiert ist.

- Ein Soundprozessor (SPU, engl. „Sound Processing Unit“) ist ein auf Klangverarbeitung und -erzeugung spezialisierter Prozessor.

Stromverbrauch von Prozessoren

Im Zusammenhang mit den steigenden Stromkosten wird der Energieverbrauch zu einem immer wichtigeren Leistungsmerkmal.

Primärverbrauch

Früher wurden neue Fertigungstechniken (v. a. Strukturverkleinerungen) vor allem zur Steigerung der Frequenz verwendet; mittlerweile werden sie teilweise eingesetzt, um den bisher stetig steigenden Stromverbrauch wieder zu reduzieren:

- Statt immer höherer Taktraten für einen einzigen Rechenkern werden nun bei niedrigerer Frequenz mehrere Rechenkerne in einem Prozessor untergebracht.

- Exaktere Fertigung reduziert Leckströme.

Aktuelle Mehrkern-Prozessoren können in ihrem Leistungsbedarf je nach Modell zwischen 45 und 140 Watt liegen (TDP). Es werden auch zunehmend Energiespar-Fähigkeiten eingebaut, um nicht benötigte Komponenten zeitweise langsamer takten zu können oder ganz abzuschalten. Bzgl. des Gesamt-Stromverbrauchs wird i.A. das Race-to-Idle-Prinzip angewandt. Moderne Prozessoren kennen mitunter sogar einen „Turbo-Modus“, um vorhandene Kühlungs-Reserven voll auszuschöpfen.

Sekundärverbrauch

Der Stromverbrauch von Prozessoren ist mit weiteren Folgekosten belastet: Der verbrauchte Strom wird in Wärme umgewandelt, diese muss durch den Lüfter aus dem Rechner heraustransportiert werden. Höherer Verbrauch erfordert stärkere Lüfter, die ebenfalls mehr Strom verbrauchen. Ist der Aufstellungsort des Rechners selbst ein klimatisierter Raum, wird auch die Klimaanlage dadurch zusätzlich belastet. Dabei kann man abhängig von der Leistungszahl des Kühlgerätes mit ca. 25-40 % Zusatzverbrauch rechnen (d. h. ein 300W-PC belastet die Klimaanlage mit 75-120W höherem Leistungsbedarf). Auch das Netzteil des Rechners muss eventuell größer ausfallen. Ist der Rechner an eine USV angeschlossen, so hat diese abhängig von ihrem Wirkungsgrad ebenfalls einen höheren Eigenverbrauch. Bei vielen Rechnern an einem Ort können auch zusätzliche Investitionskosten für größere Klimaanlagen und größere USV-Anlagen anfallen. Server laufen meist 24 Stunden am Tag, sieben Tage die Woche, also insgesamt 8760 Stunden im Jahr.

Indirekte Vorteile niedrigereren Stromverbrauchs

Aber auch außerhalb von Rechenzentren bieten stromsparende Prozessoren zusätzliche Vorteile. Da die Kühler weniger zu tun haben, werden die Rechner auch leiser. Und im Sommer stellt die von einem PC produzierte Wärme in einem Raum ohne Klimaanlage eine Beeinträchtigung für die dort anwesenden Personen dar.

Weitere Maßnahmen

Um die Energiebilanz von EDV-Systemen zu verbessern, werden unterschiedliche Lösungswege verfolgt. Es wird angestrebt, die Effektivität der Kühlung zu erhöhen (Beispiel: Air Guide), als auch die abgegebene Wärme zu nutzen (Beispiel: Aquasar).

Siehe auch

Literatur

- Helmut Herold, Bruno Lurz, Jürgen Wohlrab: Grundlagen der Informatik. Pearson Studium, München 2007, ISBN 978-3-8273-7305-2.

Einzelnachweise

- ↑ Helmut Herold, Bruno Lurz, Jürgen Wohlrab: Grundlagen der Informatik. Pearson Studium, München 2007, ISBN 978-3-8273-7305-2, S. 101.

- ↑ www.computerbase.de

Weblinks

Wiktionary: Prozessor – Bedeutungserklärungen, Wortherkunft, Synonyme, Übersetzungen

Wiktionary: Prozessor – Bedeutungserklärungen, Wortherkunft, Synonyme, Übersetzungen- 25 Microchips that shook the world, ein Artikel des Institute of Electrical and Electronics Engineers, Mai 2009

- Prozessor Rangliste aktuelle Prozessor Rangliste zum Vergleich

Wikimedia Foundation.